V2EX 热门帖子

1. 2026 年,选择 Podman 还是 Docker

Docker 对于大多数自托管应用支持的比较好,个人使用也基本熟悉了。 Podman 的无守护进程和默认的 Rootless 很好用,在服务器上测试部署了一个服务,感觉还挺好的。

作者: DejavuMoe | 发布时间: 2026-04-24 10:12

2. 我做了个工具让 8GB 显卡跑 30B 模型从 3 tok/s 提到 21 tok/s,记录一下技术发现

最近在折腾本地大模型,发现一个核心问题:Ollama 和 LM Studio 能让模型跑起来,但参数全靠猜——上下文长度、KV cache 类型、MoE expert 放哪、ubatch 多大……用默认参数基本是在浪费显卡。

于是做了个工具自动找最优配置,过程中踩了不少坑,记录一下。

核心发现

1. MoE 模型的 offload 策略决定了一切

Qwen3-30B-A3B 是 MoE 架构,在 8GB 显卡上:

- LM Studio 默认把所有层塞进显存 → 7549MB ( 93%),3 tok/s

- 只把 attention 层放 GPU ,MoE expert 层走 CPU → 2603MB ( 32%),21 tok/s

快了 7 倍,显存反而省了 65%。关键是 llama.cpp 支持这个,但你得自己识别哪些 tensor 是 MoE expert (

.ffn_.*_exps.这类命名),然后手动配。2. KV cache 类型影响比大多数人想的大

同一张 8GB 显卡跑 Llama 3.1 8B ,不同 KV cache 配置速度差异:

配置 ctx 速度 iso3+iso3 ,4 slot 8K 19.4 tok/s q8_0+q4_0 ,1 slot 8K 38.2 tok/s f16+f16 ,1 slot 8K 51.7 tok/s f16+f16 ,1 slot (自动) 64K 26.2 tok/s f16 比 iso3 快将近 3 倍。但 f16 显存占用更大,所以正确策略是:先算 f16 KV cache 占多少显存,装得下就用 f16 ,装不下再降级。

公式:

KV_MB = 2 × layers × kv_heads × head_dim × ctx × bytes / 1024²3. oobabooga 公式用来预测 ctx 上限

社区里流传的 oobabooga 显存估算公式,原本用来预测装载模型后剩余显存能支持多大 ctx 。但这个公式是基于 q8_0/f16 拟合的,用 iso3 的时候会严重高估显存需求,导致 ctx 只算出 4K 。

最后放弃公式预测,改成二分探测:从 min(nativeCtx, 65536) 开始,OOM 就减半,最多探 5 次,让 llama-server 自己告诉我能跑多少。Llama 3.1 8B 的 ctx 从 4K 直接到 64K 。

4. parallel slot 数量对单用户场景影响巨大

llama.cpp 默认开 4 个并行 slot (为了多用户并发),但单用户场景下这会把 VRAM 分成 4 份。

关掉多余 slot (

--parallel 1)之后:18.5 → 38.2 tok/s ,直接翻倍。5. ubatch 实测比理论更可靠

ubatch 128 vs 512 的性能差异跟模型和显卡都有关系,没有通用最优值。实测结论:

- 8K ctx:ubatch 512 比 128 快 7.6%

- 64K ctx:ubatch 512 比 128 快 21.6%

直接 benchmark 两个值取快的,比查文档猜靠谱。

6. 对话压缩不要用模型生成摘要

最初方案是上下文满了之后调本地模型生成摘要——结果单 slot 阻塞,直接超时。

改成纯算法提取:保留头部( system prompt + 首轮对话)和尾部(最近 8K tokens ),中间部分提取代码路径、函数名、文件名、TODO 等关键信息。压缩率 73%,耗时 <1ms 。

用了哪些技术,实现了什么功能

llama.cpp — 推理引擎核心

直接调用 llama.cpp 的 llama-server ,所有参数( ctx 、KV cache 类型、线程数、ubatch 、mlock 、tensor split )都通过启动参数注入。Kaiwu 本质上是一个参数决策层,不改推理引擎本身。

IsoQuant / TurboQuant — 3-bit KV cache 压缩

集成了 johndpope 的 turboquant fork (

feature/planarquant-kv-cache),支持-ctk iso3 -ctv iso3参数。iso3 的压缩系数实测 0.73 ,理论值 0.75 ,在 VRAM 紧张的设备( 8GB )上可以把 KV cache 占用压缩到 q8_0 的一半。但有约 600MB 固定解码 buffer 开销,VRAM 充裕时反而比 f16 慢 8%,所以策略是 VRAM > 16GB 才默认开 iso3 。oobabooga 显存估算公式 — ctx 上限预测(已放弃)

社区流传的公式用来预测剩余显存能支持多大 ctx ,基于 q8_0/f16 拟合。iso3 场景下高估显存需求,导致 ctx 只算出 4K 。最终改成二分探测代替公式,让 llama-server 自己决定能跑多少。

GQA 架构识别 — KV cache 精准估算

Qwen3 等新模型用 GQA ( Grouped Query Attention ),kv_heads 远小于 attention_heads 。KV cache 大小公式里用的是 kv_heads 而不是 heads ,不识别这一点会高估 3-4 倍。通过读 GGUF metadata 拿到准确的 kv_heads 值再做计算。

MoE tensor 识别 — 自动 expert offload

读取模型的 tensor 名称列表,匹配

.ffn_.*_exps.模式识别出 MoE expert 层,自动决定把这部分路由到 CPU 。不需要用户手动指定,也不需要提前知道模型架构。Extractive Summary — 零延迟对话压缩

上下文到 75% 时触发,纯算法提取:保留 system prompt 、首轮对话、最近 8K tokens ,中间部分按关键词权重保留(代码路径、函数名、文件名、TODO 、命令行等)。不调用任何模型,压缩耗时 <1ms ,73% 压缩率。最初试过调本地模型生成摘要,单 slot 阻塞直接超时,这条路走不通。

GitHub Actions CI — 跨平台自动编译

turboquant fork 需要自己编译带 iso3 支持的 llama-server 。用 GitHub Actions 同时编译 Windows ( MSVC )和 Linux ( GCC )版本,CUDA 12.4 ,覆盖 sm_75/80/86/89 架构,RTX 50 系列通过 PTX JIT 运行时支持。踩了三个 MSVC 编译坑( extern “C” 声明改定义、M_PI 未定义、全局符号缺失),记录在 PROGRESS.md 里。

工具

把上面这些逻辑都自动化了,叫开物( Kaiwu )。一行命令启动,参数全部自动找,结果缓存起来,第二次 2 秒启动。

GitHub: https://github.com/val1813/kaiwu

OpenAI 兼容 API ,Continue / Cursor / Claude Code 直接接。

有遇到类似问题的欢迎交流,尤其是 MoE offload 和 KV cache 这块踩坑挺深的。

作者: KaiWuBOSS | 发布时间: 2026-04-24 10:51

3. 想问下有没有对 “中英混输 + 自动记忆词汇” 支持较好的输入法方案

最好是开源方案,或者微软拼音+额外配置也可以,不要国产商业输入法。

开源方案试过 Rime 小狼毫 + 雾凇/薄荷方案,中文输入的效果非常满意,预测精准输入流畅,但是对中英混输以及英文词汇自动记忆/提前补全效果一般

微软拼音则是中英混输做的不错,英文生词记忆也挺好。但是纯中文输入就感觉磕磕绊绊,里面很多词汇的优先级有问题,常用的预选词汇经常不在第一页。完全做不到像小狼毫 + 雾凇/薄荷 那种中文输入的流畅度。

各位平时常用的输入法是什么?对这种需求,目前有什么好的解决方案吗

作者: cellsyx | 发布时间: 2026-04-24 16:56

4. 占比大幅提升!谷歌:公司内部 75%的新代码已由 AI 生成

程序员这个行业职业生涯基本到头了吧,没有再进入的必要了,之后会越来越平民化。

但是按道理应该老程序能焕发第二春了,有了 AI 加持越来越需要有编程经验的老炮。

作者: TimLang | 发布时间: 2026-04-24 06:20

5. 帮大家试过了 V4 变强了,但是也太贵了,早点出 coding plan 吧

早期,我用 deepseek-reasoner 连最基本的问题在生产项目都搞不定。但是 V4 确实能力比之前强很多了。token 也很贵,一个简单的问题 V4 Pro 花了我 5 块钱多钱

作者: devloperchen | 发布时间: 2026-04-24 08:48

6. 性价比高的 AI 有推荐的吗?

性价比高的 AI 有推荐的吗?

copilot 不能用 claude 了,想换一个

作者: qviqvi | 发布时间: 2026-04-24 14:11

7. 火山方舟 Coding Plan 慎买

火山方舟 Coding Plan 慎买啊,群里全是要退款的,又卡又慢,额度消耗的还特别快

作者: ghostman | 发布时间: 2026-04-23 07:43

8. 分享一个 Vibe Coding 的双仓库 UI 提速技巧

两个仓库

第一个仓库只负责 UI ,技术栈 Vue + Tailwind 这个仓库不管业务逻辑,只做界面和简单交互,数据全部是 mock 的。

第二个仓库是正式产品,UI 跟第一个仓库完全一致 我给每个页面都配了 1:1 的对比测试。自动化脚本会同时对两个仓库截图,只要有 1px 的偏差,测试就挂。

具体做法

所有新功能全放在第一个仓库里先做设计。因为不需要考虑逻辑,AI 可以吃进全部代码,之前的页面风格也能一并理解,改起来特别快。再加上是基于 HTML 的,随手就能部署到手机、电脑上实际操作。新功能的验证迭代都能飞一样地跑通。

第一个仓库的 UI 定稿之后,再让 AI 照着这个仓库把实际功能做进正式产品里。有现成参考兜底,AI 写出来的页面高度精准,不会跑偏。

因为有 1:1 截图测试卡着,后续再怎么迭代也不用担心 AI 手滑改坏之前的 UI 元素。

内容完全由人类构思与实践,文本经过 deepseek 润色。

作者: hamsterbase | 发布时间: 2026-04-24 11:57

9. 有没有办法在 vscode 中的 ai 插件对话中做标注?

比如高亮,能够让我快速定位到标注过的地方就行,比搜索会方便很多

作者: gegeligegeligo | 发布时间: 2026-04-24 14:56

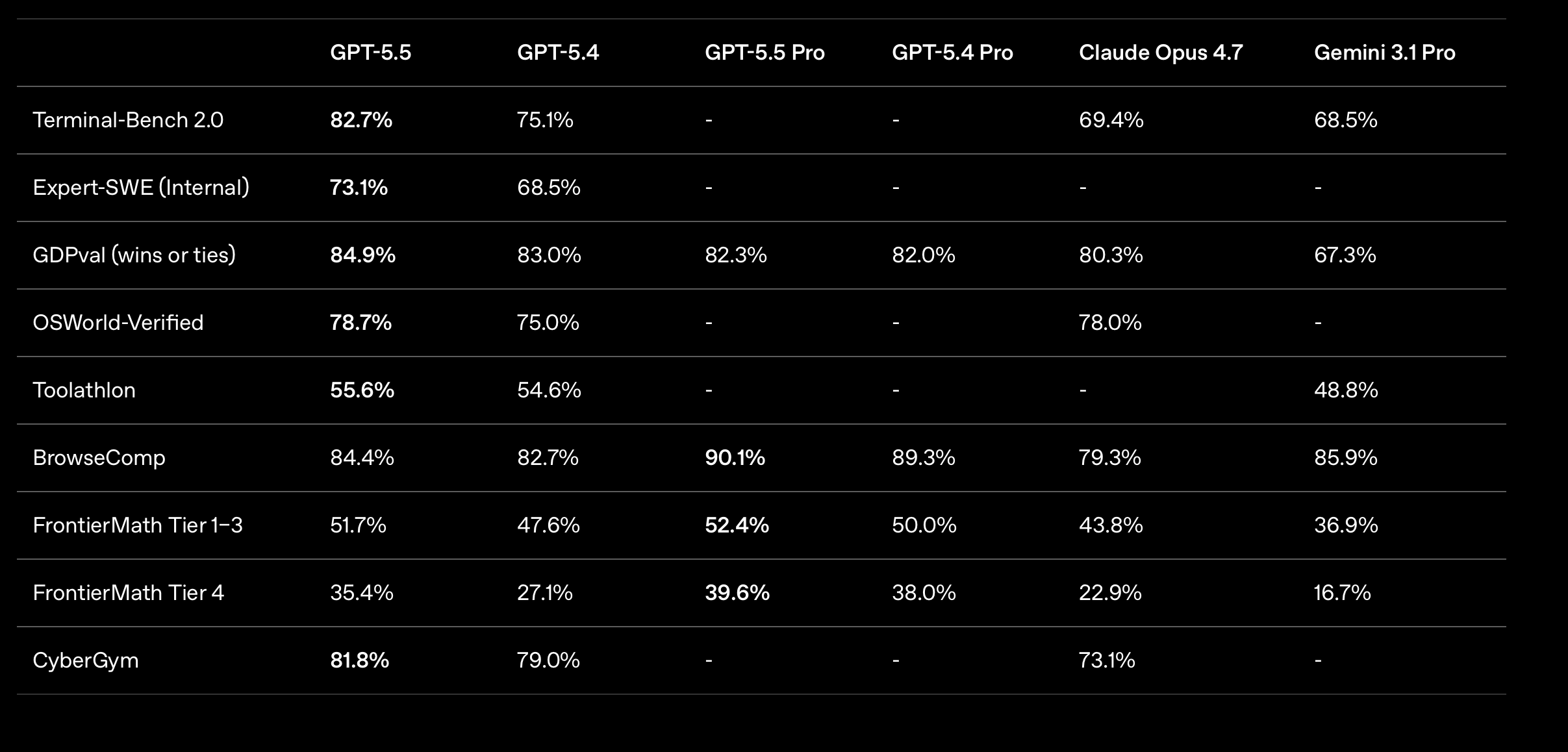

10. 天下苦 Claude 久矣, GPT 就出招了, 5.5 目测下限是 opus 4.6

1 ,输出好多了,不讲八股文了 2 ,体感变快 2 ,大上下文目测增强很多

解决了 5.4 最大的 l 几个问题,可主力使用。

我想说出早了,再等 1-2 周,Claude 继续硬着脖子说自己模型没问题。等着 claude 的口碑再烂点。奥特曼太着急了

作者: sampeng | 发布时间: 2026-04-24 00:23

11. GPT5.5 在 codex 中 credit 消耗量相比 5.4 翻倍

https://developers.openai.com/api/docs/pricing?latest-pricing=standard

Model Input Credits Output Credits GPT-5.3-Codex 43.75 350 GPT-5.4 62.50 375 GPT-5.5 125 750 天塌了啊,最新 openai 的模型越来越贵,穷人要用不起了啊

看 gpt5.5 的 token 价格翻倍了感觉不妙,结果一看 codex 消耗果然相比 5.4 也翻倍了

本来 codex 的 credit 计算规则改了后就明显消耗量加快了,结果现在 5.5 用量还翻倍了

然后 codex 中 5.5 默认的推理强度还是 extra high 。。。。。

当作和 opus 一样的高级模型好了。。。。

作者: BeautifulSoap | 发布时间: 2026-04-24 03:29

12. 今天用 codex gpt5.4 感觉像降智了

今天用 codex gpt5.4 感觉像降智了,写代码一股异味,前几天一次性就能写好了,今天写个代码我要反复给他提示几次,消耗还比之前增加了

作者: wuyiccc | 发布时间: 2026-04-24 07:48

13. clawcloud run 停运后在哪还能低成本部署 n8n

在 clawcloud 跑了一个简单的 n8n 抓取新闻啥的,现在停运了。还有哪里可以免费或低成本的部署 n8n 吗?

之前用过免费的 zeabur ,但现在看不太懂他的收费模式了。

作者: xyzzyssd | 发布时间: 2026-04-24 11:20

14. 这种图片是 ai 如何生成的呀?

作者: lvxiaomao | 发布时间: 2026-04-24 09:14

15. 没想到 2026 年,还要浪费大量时间在跨域问题上

公司后端写的接口部署到测试环境了,访问之后发现跨域了,把浏览器的跨域截图发给后端开发,问我报什么错了?难道都 2026 年还不理解跨域是什么原理吗?还需要我给他科普一下吗?心累。

作者: guansixu | 发布时间: 2026-04-23 01:23

16. codex 遇到了灵异事件。

一直是两个 gpt plus 混用,除了缓存,没遇到任何问题。

今天升级了一下 codex 。

功能改完后,想改一下风格,发完这句话以后,A 账户返回额度耗尽

然后我换 B 账户,跟 B 账户对话前,我”git inti ➡ git add .➡ git commit -m” 提交了版本。B 账户改的面目全非,我 git 还原奇怪的事情来了:git 历史变成了变得文件夹的文件。。最重要的是,B 账户告诉我,现存文件的 1893 行和 3675 行与我的要求没有任何关联。。也就是我所有我改好的代码,在我切换账户后,他凭空消失了。。。

作者: afkool | 发布时间: 2026-04-24 06:33

17. [ 模型对比 ] 用手里有的几个模型做了一个小对比

实现一个比较常规机械时钟,实现的效果如下 链接直达

作者: pedclub | 发布时间: 2026-04-24 10:31

18. chrome dev tools console 里这个 AI 有啥场景用

看起来只能生成 code ,但在 console 有啥需要他帮我写 code 的场景?

作者: wednesdayco | 发布时间: 2026-04-24 10:40

19. 现在开发 agent 应用,你们用什么框架?

langchain 还是 claude-agent-sdk ?

作者: 0bit0 | 发布时间: 2026-04-24 06:48

20. 糟了, Claude 也提前重置了周额度,包括 Claude Design

技巧

和

codex额度重置不一样,Claude 直接给你账单清零了,等于你今天可以大用特用,明天早上 8 点又会刷新周额度.

- 趁我睡觉,手机告警了,凌晨

1:06左右提前刷新的- 还是用少了,别省着,省就亏啊,昨天/今天/明天,用的猛的可以合理用完 3 个

weekly额度公告

过去一个月,部分用户反映 Claude Code 的质量有所下降。我们对此进行了调查,并针对发现的三个问题发布了问题分析报告。 所有问题均已在 v2.1.116 及更高版本中修复,并且我们已重置所有订阅用户的使用限制。

ref: https://x.com/ClaudeDevs/status/2047371123185287223

作者: mains | 发布时间: 2026-04-23 23:50

21. 发现一个新的低倍率中转

https://www.recycleai.vip/auth/register?domain=admin 好像是新开的有人去踩踩雷吗

作者: baoruiwork | 发布时间: 2026-04-24 10:20

22. 大伙有想过二次训练吗?

- 比如我下载了一个模型。

- 然后再把我所有文档交给它,二次训练。

- 那么,是不是就没必要 RAG 了。

- 通过这个模型,我就能提问了嘛,毕竟,我的基因已经嵌入进去了。

作者: archxm | 发布时间: 2026-04-24 09:58

23. Hermes agent 和小龙虾有什么平滑升级和防挂机制吗?

昨天问大家怎么去养虾,或者是养 Hermes agent ,大家都给我推荐说用笔记本或者是 Mac Mini ,我今天上班拿同事的 MacBook 试了一下,感觉踩了很多坑,刚开始用着感觉挺好用,但是让他执行一些复杂的任务就会失联,甚至崩溃,大家有什么方法吗?感觉这个入坑需要很大的技术难度,有没有什么产品适合小白,直接安装导入 key 就好了?

作者: babymonster | 发布时间: 2026-04-24 06:43

24. Roo code 没了

Roo code 宣布 5 月中旬结束官方的支持。官方转向做 Roomote ,后续的 Roo code 可能交由社区维护或者直接关停。有啥平替推荐吗?

作者: Freeman1989 | 发布时间: 2026-04-24 06:21

25. 说句冒犯的话, DeepSeek V4 Pro 让我有点破防!

同样的项目,同样的提示词,Deepseek V4 pro 出品空白,gpt5.4 都比较正常,claude sonnet 4.5 都是最强展现。

主要任务:从传统的 html 迁移到 RN 新技术栈,沿用老的后端输出,有参考项目。传统的 html 已做了页面级说明和截图。

工具:Claude Code

DS 前后浪费 29.49 大洋,是真浪费。

GPT5.4 和 Claude Sonnet4.5 价格差不多,36 左右,但是 USD ,尽管贵,但基本可用。

前期问问题的时候就已经明显感觉 DS V4 PRO 走偏了,拉几次才拉回来。不用开 OPUS ,真的不够打。

正式版本看看是否有改善。

作者: lyhiving | 发布时间: 2026-04-24 13:11

26. 一个例子又拉回了我对 DeepSeek V4 Pro 的印象,后续还是得多多测试看看

用了一个 kimi 官网的 Agent 的示例 Prompt:

「 Meridian Architecture 」高端建筑设计事务所官网,展示项目作品、设计理念、团队、获奖、联系表单、留言簿。中英双语、极简主义建筑美学、深色系(黑/深灰)+ 金铜色点缀。区块:Hero (全屏摩天大楼航拍视频 + "Shaping the Horizon" 标题 + EST.2008 标签)、Projects ( 4 个项目卡片,16:10 比例 + 编号 + 位置 + 描述)、Philosophy ( 3 列数字统计 148 项目/32 国家/26 奖项 + 工匠打磨视频)、Team ( 8 位建筑师网格)、Awards ( 10 条奖项时间线 + 6 本出版物)、Contact (表单 + 留言簿)、Footer 。技术:React + Express + tRPC + MySQL + Drizzle + OAuth + AI 聊天助手(浮动右下金色按钮)。总体效果超出预期。 DeepSeek V4 Pro 在 Claude Code 中开启了一些常见的 skill 或插件(有一个 front-design 的 skill ),效果预览: https://demo5-opal.vercel.app/

Kimi K2.6 Agent 在网页里直接生成的:https://q6bxlhhftz5de.kimi.site/

kimi 的有很多重复的图片(可能是抽卡效果不好),而且部署时间挺长,然后公开分享出来由于会占用服务器资源,还会按日扣除订阅里的额度,后面会取消公开分享。

大概过程:

- 直接在 Claude Code 里输入 Prompt ,一次性生成,本地预览前端没啥问题,日志里有一些应该不算严重的错误日志,API 花费大概 10 块钱。

- 然后我想部署出来看看,直接和 DeepSeek 讨论是否能直接部署到 Vercel ,由于项目有 MySQL 数据库,它建议分开部署,前端部署到 Vercel 。在他的提示下安装了 Vercel 的 cli 并授权了( Vercel 的 Claude Code 插件是自己手动安装的,授权那个没有明显提示,自己手动打开了它的输出里的链接进行了授权,不够友好且感觉有点不安全)。之后一次性部署成功。

- 之后发现缺少图片,它解释是说需要从后端获取,让它改成前端暂时用 mock/静态的数据,然后修改后重新部署到 Vercel 上就是上面最终的效果。

个人感受:

- 审美上:这次界面很惊艳,一个是没有滥用的圆角矩形,还有一个是那个团队那里把鼠标移到图片上的效果我很喜欢。

- Claude Code 里的使用:长任务应该没啥问题,但是可能输出有点慢,第一次本地一次性生成大概会费了 30-40 分钟,没有中断。工具调用感觉也不错,调用工具挺积极的,看了几次,调用得也比较合适。

- 由于还没有 Coding Plan ,单纯 API 计费确实不便宜,总共大概花费了 16 块钱。

有了前面的那个打脸,单纯的几次测试确实也还看不出来啥,仅供参考吧。 而且这种一次性的 Prompt 没办法看出来模型对于对于细节,项目理解,代码修改方面的水平,后续还需要更多测试,也希望能尽快出个 Coding Plan 吧,不然现在的价格确实性价比不高。

作者: dingawm | 发布时间: 2026-04-24 06:03

27. 轻度使用了 Kimi k2.6,环境是 opencode go,推理过程给人一种极其难受的感觉

推理不到点子上,整个推理过程就是无限的否定自己,推理能力堪比 qwen 的第一个推理模型 qwq-32b 。不能做到类似 glm5.1 那种言之有物,人看了会觉得真的在思考的效果。

kimi k2.6 还出现了一个非常低级的错误,我让他参考一个 kt 工程,我给了工程的文件夹路径,kimi k2.6 完全无法自主的识别到这是一个 kt 工程,grep 了半天 java 文件然后告诉我找不到。

同时还等量的使用了 qwen3.6 plus ,也是 opencode go ,尽管 opencode 声称自己 go 套餐没有量化,但是 qwen3.6 plus 多次出现了严重的死循环,很难让人相信不是量化,调低思考预算应该不会导致严重的死循环,毕竟 qwen3.6 plus 是一个 400b 的 moe 模型。

作者: defaw | 发布时间: 2026-04-24 02:54

28. 订阅导致封号问题请教

看到很多 V 友发帖说 claude 账号被封问题,我目前是使用 GooglePlay 订阅的 20 美元的 Pro 套餐,已经稳定订阅一年左右了。 目前感觉额度不够用,想升级到 5X 的 MAX(对应官网是 100 美元的)。 请问下,之前出现封号的都是 MAX 套餐的吗?是 100 美元还是 200 美元的封号概率大些,还是说只要升级到任意 MAX 套餐都会有大概率被封。 目前我使用的是台湾住宅 IP(购买 IP 时人家是这样宣传的)

作者: yoyoluck | 发布时间: 2026-04-24 03:21

29. 试用的路子是也没了吗

看了几个收藏的小店,全线涨价就不说了,plus 订阅都缺货了,只有 100+的 pro ,还都没质保,所以现在手里的号等到期了以后 codex 也不能爽蹬了是嘛:(((

作者: wnzhyee | 发布时间: 2026-04-24 04:13

30. 确定必须需要 claude code 的 max 版本吗?

看到那么多逆向的比较便宜

那么纠结为何需要 claude max20x 的版本呢?

你们是什么想法呢?我乱 我凌乱

作者: gotoschool | 发布时间: 2026-04-24 11:01

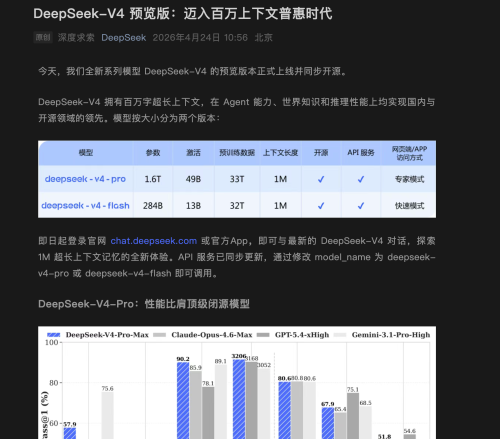

31. DeepSeek V4 预览版已发布

官方公众号:

DeepSeek-V4 预览版:迈入百万上下文普惠时代

https://mp.weixin.qq.com/s/8bxXqS2R8Fx5-1TLDBiEDg官网和 API 已经同步更新,有想要尝鲜的可以用起来了

作者: EmptyDoc | 发布时间: 2026-04-24 03:14

32. 卧槽卧槽……居然收到 A 家的道歉邮件……

卧槽卧槽……居然收到 A 家的道歉邮件…… 半个月前被封了一个 5x max 账户,然后去申诉了,一直没动静,刚半夜收到邮件说账户帮我恢复了,还给我额破了拽了…… 那是不是这个账户可以继续用了啊?可以继续充个 max ?

作者: reitao | 发布时间: 2026-04-23 22:24

33. GPT 5.5 发布了

https://openai.com/index/introducing-gpt-5-5/

API 定价比 5.4 贵

For API developers, gpt-5.5 will soon be available in the Responses and Chat Completions APIs at $5 per 1M input tokens and $30 per 1M output tokens, with a 1M context window.官方提到了在 Codex 中因为 Token 效率更高所以大概能在相同价格用量下得到和 5.4 类似的效果(持怀疑态度)

作者: Zhuzhuchenyan | 发布时间: 2026-04-23 20:18

34. codex 额度不够用啊, pro 一天花了 40%的周额度

兄弟们,太难了…难道我需要开两个账号了? 你们现在都是什么配置

作者: caorushizitest | 发布时间: 2026-04-24 03:24

35. 一行命令让 Claude Code 自己管项目

之前在 V2EX 发过几次帖子分享我在开发开源项目 Chorus,一个给 Claude Code 用的 Harness 时的经验和教训。简单说就是让 Agent 不只是写代码,而是自己管整个项目:领需求、出方案、拆任务、写代码、提交审查,从 Idea 到交付走完一条流水线。中间有独立的 Reviewer Agent 自动审方案和代码,审不过打回重做,不用你盯着,把我们从无限的 Agent Review 地狱里解救出来。

上次发帖之后老哥们反应挺热烈,Issues 里提了不少实际问题。有说装 Docker 门槛太高的,有说生成的文档导不出来没法给客户看的,有说 Onboarding 走一半卡住了的。我挨个看了,这次 v0.6.6 基本都回应了。

最大的变化现在一行命令就能启动:

npx @chorus-aidlc/chorus

跑完打开 http://localhost:8637 配合 Claude Code 插件就能用,不用配数据库,不用写 compose 文件。全栈纯 JS 实现,macOS 和 Linux 都能直接跑。

另外根据 Issue 里的反馈加了文档导出,Markdown 、PDF 、Word 三种格式。有老哥说项目交付要给客户看文档,之前只能在 Chorus 里看确实不方便,现在 Proposal 草稿阶段就能导出预览。

其他比如 Proposal 审批了发现方向不对可以撤回重来,Onboarding 不会再卡死,Agent 上线一次调用拿到所有状态接着干活,就不展开了。

详细的看博客: https://chorus-ai.dev/zh/blog/chorus-v0.6.6-release/ GitHub: https://github.com/Chorus-AIDLC/Chorus

感谢之前提 Issue 和反馈的各位,有问题继续拍砖。我的目标是让 Claude Code 自己推项目给我们省点力。

作者: fennu2333 | 发布时间: 2026-04-24 01:12

36. 五年过去了,结论有什么变化吗?

作者: dhysum | 发布时间: 2026-04-23 07:51

37. DeepSeek-V4 的预览版本正式上线并同步开源

作者: mobinf | 发布时间: 2026-04-24 03:04

38. DeepSeek 4.0 发布在即, 官网 Price plan 已经可以看到价格了

每天捏着鼻子用 A\的 Opus 真是恶心

DS 4 发布了,计划同步订阅,哪怕不用, 也支持下. 希望越做越好,把 A,奥特曼的价格打一打!

作者: Crawping | 发布时间: 2026-04-24 03:02

39. Bitwarden Cli 遭遇供应链攻击

https://socket.dev/blog/bitwarden-cli-compromised

安装了恶意 Bitwarden npm 包的组织应将此事件视为凭证泄露和 CI/CD 入侵事件。

立即从开发人员系统和构建环境中移除受影响的软件包。轮换所有可能已暴露给这些环境的凭据,包括 GitHub 令牌、npm 令牌、云凭据、SSH 密钥和 CI/CD 密钥。检查 GitHub 是否存在未经授权的仓库创建、.github/workflows/ 目录下是否存在意外的工作流文件、是否存在可疑的工作流运行、工件下载以及是否存在符合观察到的 Dune 主题暂存模式({word}-{word}-{3digits})的公共仓库。

作者: EeveeRibbon | 发布时间: 2026-04-24 02:08

40. Claude code pro 最近是不是偷偷砍了 usage?

有没有 V 友感觉最近 cc 看了五个小时 session 的 token usage 啊?这两天问不几轮对话就把五个小时的 usage 干满了,沟槽的 A/

作者: mywjyw | 发布时间: 2026-04-24 02:22