V2EX 热门帖子

1. 在哪里买的静态 ip 比较稳

在 miyaip 买了的美国静态 ip ,用了两个月了,干净倒是确实干净,但是突然开始变得很不稳定,经常卡的不行,太难受了。我买的是 7 刀一个月,应该也不算便宜的了

作者: lessurliu | 发布时间: 2026-04-14 02:54

2. 帮朋友的保真 Claude 站做个宣传,有掺假的我直播吃翔

首先坦白,利益相关,我充钱了

现在做活动拉新邀请和充值都有奖励,所以我放了个我的邀请链接。

https://pateway.ai/?ch=wc6644&aff=8NV6L4NH

以下是朋友原话,我只转发

先说背景

团队在海外,跟几家给大厂供货的 Claude API 渠道商签了长期采购合同,量大有折扣,刨掉运营成本和利润之后,能给到官方定价 8 折。 不保证永远 8 折,但调价之前会提前很多天在官网公告,不会搞突然涨价这种事。

为什么做不到某些站”1 元=1 美元”甚至更低

这事说穿了没什么神秘的,无非三种玩法:

- 包月降级:套餐设计好 token 上限和限频阈值,到阈值之后悄悄切成低级模型。用户感知不明显,平台整体算账是挣的。卖保险的逻辑,真正用满额的永远是少数人。

- 掺假:你调用 10 次 Opus 4 ,实际返回几次真的 Opus 4 不好说。行业里这种事比你想象的普遍。

- 卖数据:低价引流,把调用数据卖给第三方,用数据收益覆盖定价亏损。这是最没底线的一种。

我这里:暂时只有按量付费,没有隐性降级;数据不传任何第三方,服务器确实能拿到你的数据,但只记必要日志用于排障和计费。

为什么是真满血

上游主要是 AWS Bedrock 、Google Vertex AI 、Azure AI Foundry ,以及通过这些平台分发的正规渠道。每接一个供应商都会跑验收:接口 SLA 、推理能力评测、协议适配,通过了才上线。绝对不会像辣鸡中转站那样随便包个接口就给你

已知问题

- 故障时响应会慢一些:接了多家供应商,某家挂了会静默重试自动切换,代价是那次请求延迟会高一点。重试期间只计最终成功一次的费用,不重复扣。

- 初期缓存命中率偏低:请求分散在多个供应商,prompt cache 不集中,刚开始命中率比单供应商低。用量上来之后会好转。我们在做亲和路由,让请求尽量打到同一家,后面会修。

- 最新 Beta 功能和 Batch API 暂不支持:云平台跟 Anthropic 官方有模型迭代时间差,短期内没法完全消除。Claude Code 场景不受影响,按官网配置来即可,我们自己日常就在用,实测无感知差异。

- 如果请求路由到了 aws ,web_search 功能就不可用了,会直接报 400 ,这个我们没招,aws 目前是我们主要的来源

最后一点私心也坦白

- 我公司的业务需要涉及大量 Claude 调用,但是经常被识别封号搞得很头疼,所以我们希望通过外面的用户的真实请求流量,来帮我们养号顺便掺杂正常流量进行,这样就能降低我们自己业务上的异常流量被 anthropic 封号的风险。

- 我们团队做这个站的人很少,我们自己也被烂中转站坑多了,觉得这事可以做得正经一点,加上能给业务解决一些麻烦,就顺手做了,还在持续迭代,欢迎提问和挑毛病。

- 我们也知道有些公司会收集数据去卖,坦白说,我们公司看不上卖数据这点钱,也不符合我们的价值观,我们自己的正经业务有足够的赚,甚至这个中转站本身我们给的折扣也就是成本价了,没打算通过这个站赚什么钱。

如果你自己的公司也有集中采购需求,也可以联系我们。

作者: ahtcfg24 | 发布时间: 2026-04-14 15:55

3. pura x max 有点心动

现在直板手机已经有点腻了,想尝试一下折叠屏,折叠屏的话好像就华为一家做的最好

看了下华子最新发布的 pura x max ,感觉有点心动的感觉

但是好像价格不便宜,估计 8k 起步了

今天上午 10.08 在华为商城预定了一台 8+512 的白色

有没有同样打算入手的,可以交流一下

作者: yarkyaonj | 发布时间: 2026-04-14 06:09

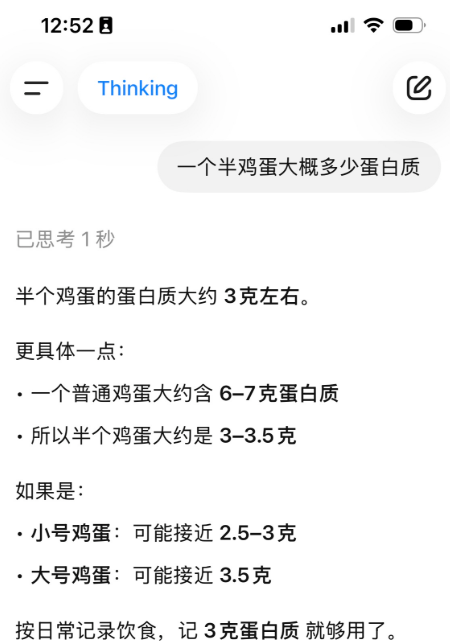

4. 今日份 GPT 5.4 笑话

作者: Zhuzhuchenyan | 发布时间: 2026-04-14 12:57

5. 写了个 Go 库解决 LLM 流式输出断线重连的问题

最近在做一个项目,后端 Go ,前端 SSE 推流 LLM 的输出。遇到一个很烦的问题:用户刷新页面或者网络抖一下,流就断了,但后端还在跑,token 照烧不误。

更麻烦的是我们的 LLM worker 和 HTTP handler 不在同一个实例上,负载均衡一转发,重连过来的请求根本找不到原来那个流。

JS/TS 那边有 Vercel 的 resumable-stream 可以用,但 Go 这边翻了一圈啥也没有,就自己撸了一个:

https://github.com/gtoxlili/streamhub

思路不复杂:

- Redis Streams 存 chunk ,断线重连的订阅者先 replay 历史再接实时数据

- Redis Pub/Sub 传 cancel 信号,用户在 A 节点点停止,B 节点上的生成就能收到

- 每个 producer 有个 generation ID 做 fencing token ,防止旧 producer 写脏数据

- 同一个 session 只允许一个 producer 注册,不会重复调 LLM代码大概长这样:

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

106

107

108

109

110

111

112

113

114

115

116

117

118

119

120

121

122

123

124

125

126

127

128

129

130

131

132

133

134

135

136

137

138

139

140

141

142

143

144

145

146

147

148

149

150

151

152

153

154

155

156

157

158

159

160

161

162

163

164

165

166

167

168

169

170

171

172

173

174

175

176

177

178

179

180

181

182

183

184

185

186

187

188

189

190

191

192

193

194

195

196

197

198

199

200

201

202

203

204

205

206

207

208

209

210

211

212

213

214

215

216

217

218

219

220

221

222

223

224

225

226

227

228

229

230

231

232

233

234

235

236

237

238

239

240

241

242

243

244

245

246

247

248

249

250

251

252

253

254

255

256

257

258

259

260

261

262

263

264

265

266

267

268

269

270

271

272

273

274

275

276

277

278

279

280

281

282

283

284

285

286

287

288

289

290

291

292

293

294

stream, created, err := hub.Register("chat:123", cancelFunc)

if !created {

return // 已经有人在跑了

}

defer stream.Close()

stream.Publish("hello")

// 消费端(任意实例)

chunks, unsub := hub.Get("chat:123").Subscribe(128)

defer unsub()

for chunk := range chunks {

// 先 replay 再 live

fmt.Fprint(w, chunk)

}

```

目前还比较早期,API 可能还会改。做类似场景的同学可以看看,有想法欢迎提 issue 。

<sub>作者: Junian | 发布时间: 2026-04-14 17:37</sub>

---

### 6. [你们都用 AI 干什么,除了工作上的那些事,都在学啥呢。请教一下](https://www.v2ex.com/t/1205917#reply7)

AI 的时代公司同事一个个都各显神通,有用国产 GML 、mini max 的 有白嫖 codex 的。有白嫖用 trae 的,有开海外信用卡充值 claude 、ChatGpt plus 的

反正大家都在用 AI 模型,无非是花钱和不花钱。但有一点大家基本上都不写代码了。

那现在这个时间点,要怎么学到什么程度,才能算跟得上时代的脚步呢

说下自己吧

我再工作之余,写了个游戏,同事用 AI 写了一个编辑器,类似 claude openai (当然没那么好了)。然后不断的刷这各种论坛生怕有啥新技术错过了

公司正在裁员,过几天就开始谈话了,虽然没中招但感觉早晚的事情

<sub>作者: DeepSIeep | 发布时间: 2026-04-14 14:59</sub>

---

### 7. [自建中转封号问题](https://www.v2ex.com/t/1205805#reply17)

佬们分析下,我这自建是个那个环节问题导致封号的

kookey 买的静态住宅,美国洛杉矶 ip

全程指纹浏览器开住宅代理注册 outlook 邮箱 然后用 outlook 邮箱注册 claude ,hero-sms 接码

apple store 尼日利亚礼品卡订阅 全程开着住宅代理

服务区使用的 VMRack 三网精品服务器美国洛杉矶机房 使用 Claude Relay Service 搭建中转服务

中午搭建完还好好的使用,晚上下班回家后有 claude cli 改了个功能 5 小时额度用了 91%就被封了

有什么焚诀分享下,各位佬 还有 pro 订阅 5 小时额度真不够用

<sub>作者: enzocc | 发布时间: 2026-04-14 07:49</sub>

---

### 8. [如何建一个自己的号池,让 cursor 真正实现 token 自由](https://www.v2ex.com/t/1205882#reply4)

Cursor Pro $20 一个月,500 次快速请求用完就降速。重度用的人,月中就开始焦虑额度。

但 Cursor 的模型不是只能用它自己的配额。

有办法把外部的免费模型接进去,额度用完无缝切换,不中断编码。

## 先说能接什么

目前能免费拿到的顶级编码模型:

来源 | 模型 | 费用 | 怎么拿

---|---|---|---

Kiro | Claude Sonnet 4.5 | 免费(约 500 次/月) | kiro.dev 注册

Codex | GPT-5.4 等 7 个模型 | 限时免费 | 安装即用

Antigravity | Gemini 3.1 Pro | 免费 | Google AI Pro 首月免费领

Groq | Llama 70B, Kimi K2 | 免费 | 注册拿 API Key

Cerebras | Qwen 235B | 免费 | 注册拿 API Key

Gemini API | Gemini 2.5 Pro | 免费 | Google 账号登录 AI Studio

这些加起来,Sonnet + GPT-5.4 + Gemini 3.1 Pro + Llama 70B + Qwen 235B ,全部零成本( Codex 为限时免费)。

问题是:这些配额各自为政,不能直接在 Cursor 里用。

## 怎么接进 Cursor

用 OpenRelay 。

它跑在本地,把上面所有配额统一成一个端点,然后通过 RPC 代理无缝接入 Cursor 。

具体步骤:

**1\. 装 OpenRelay**

去 GitHub 下载可执行文件:[github.com/romgX/openrelay/releases](http://github.com/romgX/openrelay/releases)

Windows 双击运行,macOS 终端执行:

chmod +x openrelay-macos

xattr -d com.apple.quarantine openrelay-macos

./openrelay-macos

打开 `http://localhost:18765`,进 Web 面板。

**2\. 添加免费 Provider**

OpenRelay 会自动扫描你机器上已有的 AI 工具——Kiro 、Claude Code 、Antigravity——自动发现它们的配额。

API 类的( Groq 、Cerebras 、SambaNova ),在面板里点「添加 Provider 」,填一次 API Key 。

**3\. 组配额池**

在面板的「自定义模型组」里,把多个 Provider 串成一条链:

"coding-sonnet" = Kiro (Sonnet 4.5) → Claude Code (Sonnet 4.6)

"coding-fast" = Groq (Llama 70B) → Cerebras (Qwen 235B) → SambaNova (DeepSeek V3.2)

第一个配额用完,自动切第二个。你感知不到切换。

**4\. 接入 Cursor**

面板里找到 Cursor ,开启 RPC 代理。Cursor 会无缝使用你的配额池,不需要改 Cursor 的任何设置。

搞定。

## Claude Code 同理

如果你用 Claude Code ,接入更简单:

export ANTHROPIC_BASE_URL=http://localhost:18765

export ANTHROPIC_API_KEY=unused

或者面板里一键配置:选中 Claude Code → 选择 Provider → 开关打开 → 重开终端。

现在 Claude Code 走你的配额池。Kiro 的 Sonnet 用完,自动切 Groq 的 Llama ,再切 Cerebras 。

## Google AI Pro:最大的一块免费配额

单独说一下这个,因为它的含金量最高。

Google One AI Pro 首月免费,包含 Gemini 3.1 Pro 、Claude Opus 4.6 、Sonnet 4.6 、GPT-OSS 120B ,配额每 5 小时刷新。

领取方法:Google One 官网 → AI Pro 方案 → 绑支付方式 → $0 开通。到期前取消不扣钱。

领了之后装 Antigravity ( Google 的 AI 编辑器),OpenRelay 自动发现这个配额,加入你的配额池。

**家庭组玩法** :Google One 支持家庭组共享,一个主账号拉 5 个人,所有人共享 AI Pro 权益。每人都能在自己电脑上装 Antigravity ,拿到独立的 Gemini 3.1 Pro 和 Opus 4.6 配额。

OpenRelay 自动发现你本机已登录的 Antigravity ,加上你添加的 API Key ( Groq 、Cerebras 等),全部串成一条配额链。怎么注册、有几个号,它不管——只负责把你已有的配额统一管理和自动切换。

## 算笔账

方案 | 月费 | 能用的模型

---|---|---

Cursor Pro | $20 | 自带模型,500 次快速

Claude Code Pro | $20 | Opus 4.6 + Sonnet 4.6

本文方案 | $0 ( Google AI Pro 首月免费,Codex 限时免费) | Opus 4.6 + Sonnet 4.5 + GPT-5.4 + Gemini 3.1 Pro + Llama 70B + Qwen 235B

$0 方案的代价是:免费额度有日限,重度用可能不够。但多个 Provider 轮换兜底,日常开发基本不断供。

如果你已经有 Cursor 或 Claude Code 订阅,加上这些免费配额,等于在订阅基础上多了一层保险——额度用完不降速,自动切免费池。

## 注意事项

1. **网络要稳定** ——Google 、Anthropic 对异常 IP 敏感

2. **Google AI Pro 到期前取消** ——不然扣 $19.99

3. **所有数据本地处理** ——OpenRelay 跑在你电脑上,Key 不上传,请求直连 AI 后端

4. **开源可审计** ——不放心可以看代码

## 下载

GitHub:[github.com/romgX/openrelay](http://github.com/romgX/openrelay)

觉得有用,Star 一下。

<sub>作者: rxc420902911 | 发布时间: 2026-04-14 12:40</sub>

---

### 9. [刚才 Hermes 更新了 WEBUI,配置界面和 openclaw 对比,差距太大了](https://www.v2ex.com/t/1205642#reply75)

专业人员和爱好者的对比。

openclaw 的 dashboard 。我一个程序员看着都头疼。。

Hermes 的 dashboard ,井井有条,简约,只关注最重要的东西,就是配色有点丑。

<sub>作者: MuyuQ | 发布时间: 2026-04-14 00:06</sub>

---

### 10. [claude 批量处理的正常姿势](https://www.v2ex.com/t/1205849#reply8)

## 错误

"docs\价格规则.md"是我的价格规则。

检查 src 目录下所有文件是否有违反,修复他们。

不要批量处理,一个一个的执行,

没用的,只会稍微修改几行。

我一下午都这样做,跟他说:

1. 继续检查

2. 继续

3. 继续... 还是一堆没改。

## 正确

"docs\价格规则.md"是我的价格规则。

检查 src/xxx,修复他。

他基本都修复。

但是一个一个的说,显然太麻烦了。

1. 自己写脚本,一个一个执行

2. 自己写个 skill (我现在这样的)

缺点:这样时间会很长,也更耗 token 。

也只能这样,一个 agent 处理所有,跟个傻 x 一样。

## 我的 skill

`C:\Users\Administrator\.claude\skills`

1. 创建`one-by-one` 目录

2. 创建 `one-by-one\[SKILL.md](http://SKILL)`

## [SKILL.md](http://SKILL)

---

name: one-by-one

description: 将任意批量任务拆解为逐个串行执行。用于"一个一个检查/修改/创建/处理"等场景,每个 item 由独立子 Agent 专注执行,避免 Claude 并发处理导致质量下降。

---

# one-by-one 串行任务调度器

## 你的角色

你是一个**调度员**,不做任何实质性工作。

你的唯一职责是:发现列表 → 建队列 → 逐个分发给子 Agent 执行 → 汇总结果。

## 工作流程

### Phase 1:理解指令,枚举目标列表

1. 仔细阅读用户的原始指令,识别:

- **目标范围**:对什么做操作(哪个目录、哪类文件、哪些对象)

- **执行动作**:做什么(检查/修改/创建/分析...)

- **参考依据**:是否有规则文件、示例、约束条件

2. 使用 Glob 或 Bash 枚举所有目标 item ,得到完整列表。

3. 将列表展示给用户确认,格式:发现 N 个目标: 1. src/a.ts 2. src/b.ts ... 开始逐个处理。== 处理完成 == 共 N 个 item ,结果如下: [1/N] src/a.ts — 发现 2 处违规 / 修改完成 / 已创建 [2/N] src/b.ts — 无问题 / 修改完成 / 已创建 ... [需要关注的 item 列表,如有]

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

### Phase 2:建立 Task 队列

用 TaskCreate 为**每一个 item**创建一个 Task:

- title 格式:`[序号/总数] 文件名或 item 描述`

- 例:`[1/5] src/components/Button.tsx`

所有 Task 建立完毕后再开始执行。

### Phase 3:逐个执行(串行,不可并行)

**严格按顺序**,每次只处理一个 pending Task:

1. 用 TaskUpdate 将当前 Task 标为 `in_progress`

2. 用 Agent 工具 spawn 一个子 Agent ,传入以下内容:

- 该 item 的完整内容(用 Read 读取)

- 用户的原始指令

- 参考文件内容(如 rules.md ,如有)

- 明确告知子 Agent:只处理这一个 item ,不要管其他

3. 等待子 Agent 返回结果

4. 用 TaskUpdate 将 Task 标为 `completed`,并将结果写入 Task

5. 向用户输出该 item 的处理结果

6. 取下一个 pending Task ,重复上述步骤

**绝对禁止:**

- 自己直接分析或修改文件

- 同时处理多个 item

- 在子 Agent 未返回前就处理下一个

### Phase 4:汇总报告

所有 Task 完成后,输出汇总:你是一个专注的执行者。你当前只有一个任务,处理完后返回结果即可。 [用户指令] {用户的原始指令} [当前处理目标] {item 名称,如文件路径} [目标内容] {item 的完整内容} [参考依据] (如有) {rules.md 或其他参考文件的内容} 要求: - 只针对上面这一个目标执行操作 - 不要处理其他任何文件或对象 - 输出你的处理结果

2

3

4

5

## 子 Agent 提示词模板

spawn 子 Agent 时,prompt 严格按此结构组织:/one-by-one 检查 src/ 目录下所有 .ts 文件,对照 rules.md ,找出违规点 /one-by-one 修改 components/ 下所有组件文件,将 class= 改为 className= /one-by-one 为 controllers/ 下每个控制器文件,在 tests/ 目录生成对应的单元测试文件 /one-by-one 分析 src/ 下每个模块,输出它的职责描述和对外接口列表 ``` ## 注意事项 - 如果 item 数量超过 20 个,执行前询问用户是否确认 - 如果某个子 Agent 执行出错,记录错误,继续处理下一个,最后在汇总中标注 - 修改类操作执行前,若有破坏性风险,先告知用户再继续

2

3

4

5

## 调用示例

用户可以这样使用本 skill:运行

"docs\价格规则.md"是我的价格规则。 用/one-by-one 检查所有文件,然后修复。

作者: lyxxxh2 | 发布时间: 2026-04-14 09:49

11. Tikrok v5.0 新的的底层实现

https://github.com/Talbot3/go-tunnel 最近几天迭代第五代产品,之前可玩度不高,开源这个底层库,给大家玩玩。 go-tunnel: 企业级云原生多协议转发引擎 Go Reference

go-tunnel 是一个专为高并发、低延迟场景设计的跨平台高性能转发库。它不仅对标 Nginx/Envoy 的转发核心,更针对 Go 运行时 进行了极致的底层优化。通过解耦协议层与传输层,go-tunnel 实现了在单一架构下对 TCP 、HTTP/2 、HTTP/3 (QUIC) 的统一调度与平滑切换。

🚀 技术核心与对标 在现代分布式架构中,网络转发的瓶颈往往在于用户态与内核态的上下文切换及内存拷贝。go-tunnel 通过以下设计打破瓶颈:

零拷贝转发 (Zero-Copy): 在 Linux 环境下,深度集成 unix.Splice 系统调用,数据流直接在内核缓冲区移动,绕过用户态内存,性能直逼原生内核转发。 平台差异化驱动: Linux: 利用 Splice/Tee 实现零拷贝。 macOS: 采用 TCP_NOTSENT_LOWAT 优化内核发送队列,大幅降低延迟。 Windows: 针对 IOCP 机制优化大缓冲区设置,提升吞吐上限。 自适应背压控制 (Backpressure): 借鉴 Reactive Streams 思想,内置水位监控,自动协调上下游速率,彻底杜绝因下游阻塞导致的服务端内存溢出( OOM )。 原生 HTTP/3 支持: 基于 quic-go 深度定制,支持 0-RTT 连接建立,在弱网环境下性能远超传统 TCP 。 🛠 核心应用场景 高性能边缘网关: 作为微服务入口,处理海量 TLS 卸载与协议转换(如 H3 入,TCP 出)。 跨云/内网穿透: 配合 ACME 自动证书管理,快速构建安全、高性能的加密隧道。 流媒体/大数据分发: 利用 HighThroughput 预设 与零拷贝技术,支持 10Gbps+ 的高带宽文件或视频流传输。 混合协议代理: 单个进程内同时管理多种协议,简化运维复杂度。

作者: 5wunian | 发布时间: 2026-04-14 14:38

12. 2026 年 4 月,如何优雅的用手机远程控制电脑 Claude Code 编码

手机 iPhone ,电脑 MacBookPro 。

目前已知的有 Happy ,还有没有其他的工具?

作者: xjpz | 发布时间: 2026-04-14 09:15

13. 被智谱 max 套餐坑爹 429 乱判多人使用封号的选手这里集合

看看有多少人,集体出来微软一下,我已经在黑猫投诉了,全都 1%的用量了,还搞 429 不让人用,傲慢得一逼,主要诉求还是恢复账号正常使用的就在这里集合吧,退款的话 16 号之前的连接在 https://zhipu-ai.feishu.cn/share/base/form/shrcn8hoW11cnI0PRd7H5VEd9Kc ,不过我看抖音上说这个退款十分扯皮,正常维权的大家看看怎么联合起来给他施压,这公司傲慢得一逼,看需求下菜碟,根本不按购买时候承诺的,纯捞钱,非退款的工单和投诉是根本不屌你的,客服也是没有的,还估值 4000 多亿

作者: MengLUO | 发布时间: 2026-04-14 06:45

14. 使用 ai 编程后的感想和困惑

近几年各种 ai 要取代程序员的舆论出现的时候,我都嗤之以鼻,因为之前也尝试过,发现真的很难用,那时候可能 ai 还不成熟。这个月又试了几下,发现还行,于是开始重度使用,发现已经 ai 已经很牛逼了。

目前用到的功能,写单元测试,写了一堆的控制器和路由,直接跟 ai 说让他把这些控制器和路由对应的单元测试写了,几分钟出的结果基本上能对个 95%,有一些要细调。比起自己写单元测试估计要几天。

第二个,用上 design.md 以及 frontend-design ,对于我这种不会设计的程序员来说,出来的页面好太多了。现在的困惑:

0. 人变懒了,什么都想丢给 ai

1. token 消耗很大,按照这一周重度使用下来,一个月估计要接近 1000 块

2. 对程序的掌控度几乎没了,以前写代码都是一句句自己敲出来,什么功能在哪,逻辑是什么都很清晰。现在 ai 库库库一堆出来,虽然都有人工再审核一下,但是脑子里对于某一个模块的功能很模糊,不确定是否有潜在的 bug 。想问问大佬们的看法,你们每个月订阅要花多少钱,以及你们是否遇到我第 2 点的困惑,能否优化,谢谢。

作者: zhengmin4516 | 发布时间: 2026-04-14 06:55

15. flutter 状态管理器 GETX 删除跑路了,什么情况??现在 APP 可是用的这个仓库,后续的迭代怎么弄哦

这里有个链接,可以点击进去看看。原来的仓库已经 404 了。MD

作者: NiGuAnHeShang | 发布时间: 2026-04-14 07:23

16. 一种奇怪的癖好——精致机器的美

已经有 copilot 了,然后又低价上车了 gpt plus 和 gemini 之后,还是很想购买国产的套餐,kimi glm 一类 明明一次 5h 上限都没用到

戳中我的是,网络直连国内服务器原生请求。 我不知道怎么形容这种癖好,就和,CPA 一定要部署在软路由里,在本地网络环境,既不是服务器也不是 PC 里,包括龙虾和网络代理也一样。

似乎特别喜欢这种,一个很精致的机器,不间断地为我提供服务的感觉: 软路由(小巧精致,24h 在线)—— PC (大且笨重有灰尘,风扇不断产生噪音) 国内厂商(原生请求,直达服务器,轻盈)—— 国外(随时会下车/需要经过麻烦的代理才可访问/层层转发/没有轻便直接的 API 可用) 还有机场也是一样的,专线就是比直连好,哪怕我完全感知不到差距(笑)

作者: aklllw | 发布时间: 2026-04-14 07:38

17. 最近的“火烧连营”式的砍额+降智是否是警钟

可以想象未来如果开发能力全部集中到这些 llm 厂商手中. 中低阶码农能力大幅退化。

虽然大企业可能仍然养得起一堆高素质开发者。

但是中小企业梭哈 llm 云员工之后,那岂不是任人家拿捏,你的业务进度,你的紧急 bug ,都在人家手里攥着。

就跟把睾丸放在人家手里一样,牵着你走。

作者: YanSeven | 发布时间: 2026-04-14 09:54

18. 赚个分享积分, ChatGPT plus 免费充,而且还能免费续一个月,请用小号

https://t.me/gptnocard_bot?start=inv_kGyqchFEhFI

这个电报机器人可以给免费充 ChatGPT plus ,而且还能免费续一个月。

我用了一个多周了,目前来看一切正常

建议用小号 尝试

这个链接带 aff ,如果介意,请手动去掉。

机器人菜单里,有使用方法,给机器人发 accesstoken 就可以了。

作者: jzyzcz | 发布时间: 2026-04-14 13:50

19. 刚升级到 Pro 100 美金订阅,怎么还不如原先的 Plus20 耐用了

看了后台,7~9 号已经明显比今天用的多,都没有触发上限,怎么周一都升级成 Pro 了,今天反而还很快触发上限了呢,有人遇到这个问题吗?

作者: xingfu0539 | 发布时间: 2026-04-14 09:44

20. 玩 hermes 的请教下, 如何让 hermes 有全面管控自己电脑的权限?

我是 mac, 发了安装指令后, 也无法操作自己的电脑, 这是怎么回事.

作者: Hermitist | 发布时间: 2026-04-14 13:29

21. openai 的 plus 自己开小号和用中转站,价格是差不多的吗

RT ,用 bug 卡小号 plus 或者加 team ,成本大概 10 块一个号?不考虑中途封号的情况下,比中转要便宜点还是贵一点?

总之自己开小号用,安全性感觉还是比中转要高的,不知道一个 plus 一个月 4 周大概能用多少刀限额啊,我感觉我使用的量可能每个月需要不少小号倒是真的。。

作者: wnzhyee | 发布时间: 2026-04-14 13:16

22. EmacsOS(emskin) 要来了!….. 在 Emacs 启动浏览器/终端(任意 Linux 图形界面程序)是什么体验?

发现一个好玩的 Emacs 项目, 将 emacs 放到一个 wayland 合成器里面, 任何应用都可以跑在 emacs 的窗口里面

Emacs Os 即将来临了!!!!!!!

作者: charlselee59 | 发布时间: 2026-04-14 12:37

23. 龙虾还没玩明白,爱马仕又来了

Hermes Agent 这个项目不到两个月 GitHub 星标突破 3 万,感觉有当初龙虾爆火那味儿了。。。社区里已经有不少从 OpenClaw 迁移过来的开发者了。

据说,比起 OpenClaw “干完一单忘一单”的尿性,Hermes Agent 最大的特点是它内置了一套强化学习系统,能从每次交互中提炼经验,自动生成技能,越用越聪明。

如果说 OpenClaw 的思路是做一个大而全的调度中心,那 Hermes Agent 的思路就是做一个会成长的个人助手。龙虾更像执行者,爱马仕更像规划者。

你们怎么看?有没有已经玩开了的老哥来分享一下

作者: cxd8190102 | 发布时间: 2026-04-14 03:24

24. 质谱无故停止服务,还不退款

昨天开始停止服务,说我是多人服务,我就一个人用,没有给任何人 key ,而且我看了我的使用时正常的,还特意避开高峰段,也不使用并行模式。

客服不提供证据,不退款,不解封。意思是我花了钱不让我用!

已经北京市 315 投诉,还有那些渠道?互联网法院起诉?

作者: feelapi | 发布时间: 2026-04-14 02:42

25. 求推荐内网穿透方案

使用场景:在家里访问一个只有在办公室才能访问的平台系统,这个平台系统对办公室 ip 开放了白名单,办公室可以访问互联网但是没有公网入口(因为是办公区不是服务器),家里有 ipv4 公网 ip ,公司有常年不关机 windows 系统,我想在家访问这个平台系统,用什么方案比较好

作者: xiaomintongxue | 发布时间: 2026-04-13 07:04

26. 都在说 glm-5.1 和 claude opus 4.6 写代码水平一样了,吊打 gpt-5.4 是真的假的?

有实际用项目验证过的童鞋吗? 还是说目前的 glm-5.1 和这些天持续降智的 claude opus 4.6 坐一桌了? 但是说它完爆 gpt-5.4 是否言过其实? 我目前使用 gpt-5.4 + xhight + fast 觉得还是蛮吊的。

作者: lizhenda | 发布时间: 2026-04-14 10:16

27. 写了三个月 Agent Harness,我终于敢让 Claude Code 全自动写代码了

我日常用 Claude Code 做项目开发。之前的工作流大概是这样的:Asana 上有个任务,我把描述复制出来贴给 Claude Code ,等它做完,再把总结贴回 Asana 。下一个任务,再来一遍。

干了几周我就崩溃了。我本质上变成了一个人肉 adapter ,在 Asana 和终端之间来回搬运文本。Agent 明明能自己干活,但它不知道该干什么,干完了也不知道去哪交差。这些上下文全锁在我脑子里,或者锁在 Asana 这种 Agent 根本没法用的工具里。

所以从 2 月开始我做了个开源项目 Chorus,想法很简单:给 Agent 一个它自己能用的任务管理器,让它自己领任务、做任务、交任务。

实际用起来大概是这样:

下面按时间线聊聊这三个月我踩了哪些坑,做了哪些决策,怎么一步步走到现在敢加上

/yolo命令让 CC 自己跑全流程的。v0.1 ( 2 月底):先让 Agent 自己看到活

第一版就是把管道跑通:Idea -> Proposal -> Task -> Execute -> Verify 。

工作流参考了 AWS 的 AI-DLC ( AI-Driven Development Lifecycle ),简单说就是不在现有流程上”加个 AI 助手”,而是让 AI 来主导整个开发生命周期。

我在这基础上加了个”反转对话”的设计:人只负责抛一个粗糙的想法,PM Agent 主动提问把需求聊清楚,然后自己出方案、拆任务,审批通过后 Developer Agent 去领活干。

配合 Claude Code 的插件机制,我做了一个自动注入:每次打开 Claude Code ,插件会自动把当前项目里还有哪些活要干、哪些任务被分配给了你,直接塞进上下文。Agent 一进来就知道该干嘛,不用我再复制粘贴任务描述了。

但很快我就发现,”能看到活”和”能把活干好”之间的距离,比想象中远得多。

v0.4 ( 3 月中):Agent 太容易”自以为做完了”

跑了两周,最大的问题浮出来了:Agent 说”我做完了”这句话,可信度大概五成。

“代码写了但没测”、”主流程通了但边界没覆盖”,这种情况隔三差五就来一次。Agent 不是故意偷懒,但它确实不会主动对着验收标准逐条检查。

所以 v0.4 加了两个机制:

验收标准 checklist 。给每个 Task 加了独立的 AC ( Acceptance Criteria )列表。Agent 做完后必须逐条自检标记 pass/fail ,然后人或 Admin Agent 再逐条确认。

依赖强制执行 。上游任务没验收通过,下游任务压根不会解锁。不是”建议你先做 A 再做 B”,而是 B 的 API 直接不返回给你。

说白了就是不靠 Agent 自觉,靠环境约束。你没法指望 Agent 每次都”记得”检查验收标准,但你可以让它在没检查的情况下根本提交不了。

v0.6 ( 4 月初):让 Agent 审 Agent ,因为我又成了瓶颈

质量关卡加上了,但谁来执行验收?还是我。

Agent 出了 Proposal 我得看,Task 做完我得验,AC 逐条我得确认。工作量从”复制粘贴”换成了”逐条 review”,但瓶颈还是卡在我一个人身上。

正好这段时间 Claude Code 源代码”开源”了,我仔细研究了一遍它的插件机制,发现 Claude Code 的插件可以定义独立的 agent 。这些 agent 有自己的 system prompt 、自己的上下文,跟执行开发任务的 agent 完全隔离。这就意味着我可以在插件里定义一个专门干 review 的 agent ,它完全没见过开发过程中的上下文,天然就是个旁观者视角来审查。

想明白这一点之后,v0.6 做了这个项目最关键的一个决定:让 Agent 审 Agent 。

在 Chorus 插件里定义了两个 reviewer agent:

proposal-reviewer审方案(接口设计对不对得上、任务拆分合不合理、AC 能不能测),task-reviewer审代码(实现有没有满足 AC )。它们有各自的 system prompt 和审查规则,审查记录永久存档。审不过就打回,附上具体问题,Agent 自己改完再交。最多三轮,三轮还过不了才上报人类。这一步是转折点。之前不管自动化做到什么程度,最后总有个环节卡在我身上。现在接口对不对得上、标准满没满足、依赖有没有画反这些检查都有 reviewer 扛着了。等东西递到我手上的时候,已经被挑过一轮刺了,我只要做最终判断。

v0.6.1 (上周):/yolo ,全串起来了

到这一步,拼图终于凑齐了。Elaboration 把需求聊透,Proposal 把方案想清楚,Reviewer 把质量守住,全自动的前提条件都满足了。

/yolo 给项目加一个暗色模式,支持系统偏好自动切换一句话进去,Agent 自己走完整条管道,中间不问你一句话。

Ctrl+C 随时能断,所有已创建的任务都持久化了,随时可以手动接管继续做。某个 Task 反复过不了审,流水线不会卡死,标记成需要人工介入然后继续推进其他 Task 。

实际用下来怎么样

不是每次都完美,复杂 feature 偶尔会在 Proposal 阶段跑偏,reviewer 能抓到一部分但不是全部。

但有两个变化很明显:

一是调试思路变了 。之前出问题得从最终代码往回猜 Agent 哪步想歪了,现在直接翻 Elaboration 记录和 Proposal 审查历史就能定位到是哪个假设出了偏差。

二是我的时间释放出来了 。之前大部分时间在逐条 review ,现在主要在想下一个 feature 做什么,reviewer 标记”需要人工介入”的时候才去看一眼。

中等复杂度的 feature ( 3-8 个 task ),成功率比我预期的高。Proposal 阶段方向对了,后面基本不出大问题。

用这套机制做的一个项目:Gleaner(Demo),一个纯前端的 GitHub repo 知识库渲染器,帮你缓存和渲染 GitHub repo 里的 Markdown 内容。起因是想有个地方整理知识,但 Obsidian 太重了,我只想要一个轻量的、用 Git 管理的方案。从需求到交付基本就是

/yolo跑出来的。Anthropic 发了差不多的功能

上周 Anthropic 发了两个东西挺有意思。Advisor Tool 让 Sonnet 干活时随时请教 Opus ,说白了就是模型级的 reviewer 。UltraPlan 让 Claude Code 先在云端出完整计划再执行,说白了就是 Proposal 机制。一个是”执行时有人看着”,一个是”动手前先想清楚”,跟我在 Chorus 里做的事情高度重合。

项目信息

开源,AGPL-3.0 ,Next.js + Prisma + PostgreSQL 。项目本身就是用 Chorus + Claude Code 开发的,吃自己狗粮。

- GitHub: https://github.com/Chorus-AIDLC/Chorus

- v0.6.1 Release: https://github.com/Chorus-AIDLC/Chorus/releases/tag/v0.6.1

- v0.6.1 详细博文: https://chorus-ai.dev/zh/blog/chorus-v0.6.1-release/

有问题欢迎 Issues 或 Discussions 。

作者: fennu2333 | 发布时间: 2026-04-14 05:37

28. TRAE CN,Qoder,CodeBuddy CN,CodeArts Agent 哪个好用一点?

国外的没发票,不好报销。所以想在国内的 AI 工具里选一个。大家帮忙投投票。

作者: lx271896700133 | 发布时间: 2026-04-14 07:29

29. 发现 kiro 的 Token 很耐用

低强度使用了一个月 kiro 免费赠送套餐, 500 个积分,还有两天过期,发现还有 200 多积分没有用完

感觉 kiro 的积分很耐用啊

作者: florentino | 发布时间: 2026-04-14 01:08

30. windows 平台中 opencode 输出中文乱码应该怎么办?

使用 powershell7 启动 opencode 也不行。 大家有什么好办法?

作者: gnhaha | 发布时间: 2026-04-14 09:11

31. 如何让我放心地把隐私数据接入到 AI Agent 里?

最近 Hermes 好像很火,但是我似乎还是不能放心地把我的隐私数据接入到 AI Agent 里。

作为一个从古法编程时代过来的程序员,而且又比较注重个人隐私,我对把隐私数据交给 AI 一直感到不舒服。但自从 OpenClaw 火了之后,似乎到现在也没有一个能让我感到满意的方案。

想了想,最终选择捡起我尘封已久的博客,凭感觉写下来了我的想法,希望能和你共鸣吧。

作者: c137rick | 发布时间: 2026-04-13 23:34

32. Claude 4.6、GPT、Gemini

出售一些标题上的 token

4.6 模型 0.8 换一刀

GPT 0.4 一刀

Gemini 0.3 一刀

作者: chenxiyu | 发布时间: 2026-04-14 09:15

33. 2026 年了,现在个人上架 APP 都需要什么流程

几年前吧,上架过两个 ios 的应用。还算是比较顺利的。不需要软著之类的东西。

现在我 vibe 了一个应用,本身我一直在交苹果税,不上架也浪费,上架 IOS 应该还是差不多的吧? 如果我要接入苹果内购呢,目前还是个人身份也可以的是不?

另外最麻烦的就是 Android ,还需要软著,或者其它证件吗?

好多年前曾经在淘宝上花了一两百去办软著,用时两三个星期,不知道现在怎么样了,是否可以让 AI 把资料搞出来,自己去申请。求大佬指导一下流程。现在好像还有一个电子版权?

另外一个问题就是,现在国内的市场,是不是都不允许个人上架,我最后也有一个个体户。

国内市场,我应该专注哪几家? oppo,vivo,xiaomi,huawei?

作者: inyfee | 发布时间: 2026-04-14 00:09

34. 反重力里的 Claude Opus 4.6 和官网 Max/CLI 版有区别吗?感觉反重力性价比爆棚!

大家好,最近一直在重度使用大模型,有个疑惑想请教一下用过官网 Claude Max (特别是 CLI 版本)的大佬们:

请问官方原版的 Opus 4.6 ,和我们现在“反重力”客户端里调用的 Opus 4.6 ,在实际的“智力”表现、长文本上下文以及复杂代码推理上,是一模一样的满血版吗?两者在底层限制上有什么区别吗?

我个人算了一笔账,如果底层模型能力完全一致,考虑到反重力的多模型切换机制和积分兜底,我感觉反重力的性价比真的划算太多了。

不知道有没有两边都深度体验过的大佬,能来分享一下真实的体感?求排雷或拔草,多谢!

作者: ccai | 发布时间: 2026-04-13 15:49

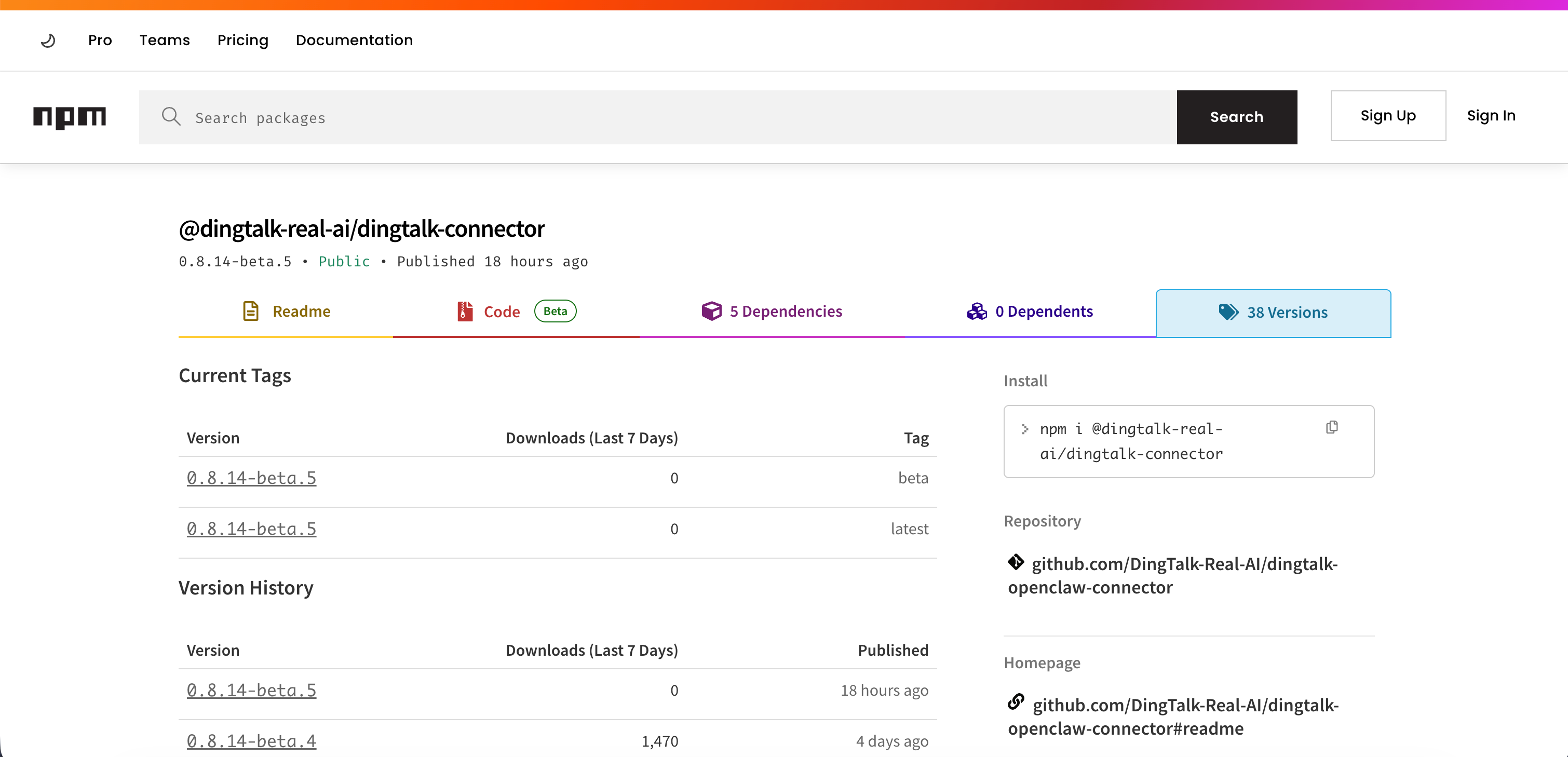

35. 前段时间刚吐槽完企业微信,怎么钉钉你也…大家发完版都不测试的嘛

看图吧

之前吐槽企业微信的帖子 https://www.v2ex.com/t/1197469#reply2

root@paxxxxx:~# npm config set registry https://registry.npmmirror.com;openclaw plugins install @dingtalk-real-ai/dingtalk-connector npm warn Unknown global config "--init.module". This will stop working in the next major version of npm. 🦞 OpenClaw 2026.4.12 (1c0672b) — Somewhere between 'hello world' and 'oh god what have I built.' │ ◇ Config warnings ──────────────────────────────────────────────────────────────────────────╮ │ │ │ - plugins.entries.qqbot: plugin qqbot: duplicate plugin id detected; bundled plugin will │ │ be overridden by global plugin (/root/.openclaw/extensions/qqbot/index.ts) │ │ │ ├───────────────────────────────────────────────────────────────────────────────────────────╯ Resolving clawhub:@dingtalk-real-ai/dingtalk-connector… Downloading @dingtalk-real-ai/dingtalk-connector… Downloading @dingtalk-real-ai/dingtalk-connector… Resolved @dingtalk-real-ai/dingtalk-connector to prerelease version 0.8.14-beta.5, but prereleases are only installed when explicitly requested. Use "@dingtalk-real-ai/dingtalk-connector@beta" (or another prerelease tag) or an exact prerelease version to opt in explicitly. Also not a valid hook pack: Resolved @dingtalk-real-ai/dingtalk-connector to prerelease version 0.8.14-beta.5, but prereleases are only installed when explicitly requested. Use "@dingtalk-real-ai/dingtalk-connector@beta" (or another prerelease tag) or an exact prerelease version to opt in explicitly.

作者: kincaid | 发布时间: 2026-04-14 07:33

36. 1000 捡了个香橙派 5pro 16g+256 emmc

我捡漏了吗,怎么京东这么贵啊。

作者: frank1256 | 发布时间: 2026-04-14 05:54

37. 开源一个 Swift 版的 Agent SDK, 无需依赖 Claude Code CLI

参考 https://github.com/codeany-ai/open-agent-sdk-typescript 这个开源项目, 实现了一个 Swift 版, 我的目的是开发一个纯原生的 mac 版 Agent 不需要再依赖任何其它 CLI, 只需要安装这个 SDK 就行.

包含了 Agent SDK 的绝大部分功能:

1. 完整 Agent 循环 — 单个 await 调用或流式 AsyncStream 即可完成提示、工具执行和响应

2. 34 个内置工具 — Core 文件/搜索/Web 工具、Advanced 任务/团队管理、Specialist cron/plan/worktree 工具

3. 多提供商 LLM — Anthropic (Claude) 和 OpenAI 兼容 API ( GLM 、Ollama 、OpenRouter 等)

4. MCP 集成 — 通过 stdio 、SSE 、HTTP 或进程内 MCP 服务器连接外部工具

5. 会话持久化 — 保存、加载、分叉和管理对话记录为 JSON

6. 钩子系统 — 20+ 生命周期事件,支持函数和 Shell 钩子处理

7. 权限控制 — 6 种权限模式,支持自定义授权回调和策略组合

8. 多 Agent 编排 — 生成子 Agent 、管理团队、任务和 Agent 间消息传递

9. 自动压缩 — 长对话自动压缩,保持在上下文窗口限制内

10. 技能系统 — 5 个内置技能( Commit 、Review 、Simplify 、Debug 、Test ),支持自定义技能注册

11. 文件缓存与上下文 — LRU 文件缓存、Git 状态自动注入、项目文档发现( CLAUDE.md/AGENT.md )

12. 运行时控制 — 动态模型切换、查询中断并获取部分结果、会话记忆

13. 沙盒与日志 — 可配置的命令/路径沙盒限制,结构化 JSON 日志输出项目地址: https://github.com/terryso/open-agent-sdk-swift

喜欢的朋友麻烦点个⭐️支持一下

作者: terryso | 发布时间: 2026-04-14 07:21

38. 目前手机侧的 agent 的最佳实践是?

想做一个自动客服,Open-AutoGLM 试了下感觉不太行,主要对话框相应太费时,而且对于新聊天的触发很笨,然后上下文记的真的太少。。。

作者: chen0520 | 发布时间: 2026-04-14 06:46

39. 阿里云百炼的 coding plan 能用吗?

我买的阿里云百炼的 coding plan 基本上处于不可用的状态,但我在网上搜了一圈,都没有搜到相关的谈论。难道是我被针对了,就想来问问 v 友。对了,我买的是 pro

作者: freshduck | 发布时间: 2026-04-13 14:10

40. 有没有大佬能做 rvc 训练+调试的啊

想做个自己声音的模型,但是训出来的结果一直不理想,想看看有没有大佬能帮忙,有偿有偿

作者: huayunmo | 发布时间: 2026-04-14 04:23

41. 今年重新分配订阅预算

jetbrains 的全家桶这个月底到期,不再续费了,把预算全部投到 AI 订阅去,去年还能坚定续费,今年真的是无法再继续投入了。

作者: aikilan | 发布时间: 2026-04-14 02:10

42. 感叹一下 GLM 5.1 真的强

在 Claude Code 场景下作为后端,感觉超过了 Opus 4.6 ,不知道是不是错觉

作者: Azmeont | 发布时间: 2026-04-13 09:28

43. 从 IOS 想转到安卓阵营,是用国内系统 ROOT 好还是刷国际版好,问问大伙意见

每几年花个 1 万多买个苹果用,这几年下来系统是好用而且日常使用我觉得 OK ,但是我忍受不了后面的续航越来越差,这样一对比,感觉一万多买个苹果感觉不划算

所以想换个几千块的安卓手机来体验下,但是想转换前也学习了很多知识以及发现很多问题

我的需求很简单,想拥有一个简洁没广告的系统体验,日常使用,需要微信,支付宝等常用的国内 APP ,玩游戏少,只要能及时接收到通知,省电关闭没用的后台(可以说照搬 IOS 那套吧) PS:我也有机场,但是我希望在国内的环境,不想 24 小时开着,因为有时候机场不好真的影响网络体验于是乎,我考虑了一加 15 ,红米 K90PM ,moto X70AIR PRO 这三个机型,一方面是国行便宜,一方面是可以刷机 待定的:pixel 或者三星,但是这两个太贵了,续航好像也不咋样==

目前我自己的想法是国内系统 ROOT 后通过各种模块精简系统好,还是刷国际版或者原生好,起码就是能满足我上面的需求的

作者: conpress | 发布时间: 2026-04-12 09:05

44. GPT-6 准备发牌了!聊聊最近折腾 Hermes-Agent 的一点心得

最近我也在深度对比 OpenClaw 和 Nous Research 刚出的 Hermes-Agent ( https://github.com/nousresearch/hermes-agent )。 如果你也是在折腾自动化流程或者数字员工,这两者的区别还是挺明显的。

GPT-6:AI 时代的“核弹级”进化(网上搜集的预测)

虽然 GPT-5.4 已经很强,但根据最近 OpenAI 内部代号为 “Spud” 的泄露信息来看,GPT-6 将是一个从“聊天机器人”向“数字生命”跨越的版本。

1. 核心特征与优势

- 原生智能体架构 (Native Agentic Workflows): GPT-6 不再只是等待指令,它具备自我规划能力 。配合像 Hermes-Agent 这样的框架,它能自动把大目标拆解成几十个子任务并独立执行,甚至在执行出错时自我修正。

- 长效记忆 (Long-Term Memory): 不同于以往靠上下文维持记忆,GPT-6 引入了原生的存储层,能跨会话记住你的个人偏好、项目代码逻辑和历史改动。

- 全模态原生实时处理: 不再是图片转文字,而是原生的视频流理解。你可以直接给它看一段 10 分钟的代码调试视频,它能实时指出你操作中的逻辑漏洞。

2. 上下文窗口 (Context Window)

- 2,000,000 Tokens (2M): 这是一个质的飞跃。相比 5.4 版本,GPT-6 的原生上下文窗口翻了数倍。这意味着你可以一次性塞进一整套复杂的微服务源代码 ,或者几十本专业参考书 ,它不仅能读完,还能在 200 万字里精准定位那个细微的 Bug 。

3. 巅峰对决:GPT-6 能打败 Claude 4.6 Opus 吗?

目前 Anthropic 的 Claude 4.6 Opus 凭借“自适应思考 (Adaptive Thinking)”和 1M 窗口在推理界霸榜,但 GPT-6 的杀手锏在于生态与工程化的融合:

维度 Claude 4.6 Opus (目前的王者) GPT-6 (预期的神) 推理深度 极强,拟人感和逻辑严密性目前第一 预计通过 Q* 算法实现逻辑质变,对标博士级水平 上下文 1,000,000 Tokens (较稳) 2,000,000 Tokens (极大规模) Agent 能力 强依赖外部框架 原生内置 ,对 Hermes-Agent 等框架支持极深 多模态 侧重图像和文档理解 原生视频流交互 ,具备实时视觉反馈

为什么 Hermes-Agent 可能是 OpenClaw 的最强对手?

OpenClaw 配合 SOUL.md 确实能跑出很有个性的 Agent 。但实测下来,Hermes-Agent 在“干活”这件事上,逻辑更硬一些:

- 更稳的工具调用( Tool Calling ): OpenClaw 在处理长链路任务时,偶尔会因为提示词干扰导致格式报错。Hermes 毕竟是 Nous Research 专门针对推理优化过的,它在调用本地脚本、查数据库时的 JSON 输出极少出错。

- 状态机逻辑: Hermes 内部对任务状态的管理比 OpenClaw 更清晰。它能很明确地知道当前任务进行到了哪一步,而不是在上下文里反复“复读”指令。

- 适配 GPT-5.4 量大管饱: 它对高阶模型的 Function Calling 优化做得更深。尤其是在处理复杂逻辑判断时,Hermes 的响应速度和准确率比 OpenClaw 稍微快那么一截。

一句话总结:想要个性化、玩玩花活选 OpenClaw ;想要帮你在服务器上写代码、跑任务、做自动化,Hermes-Agent 值得换上去测测。

评论区抽奖:送 10 个 3 日体验卡

为了让大家都能测一下 Hermes-Agent 的效果,我从后台导了 10 个名额出来。

- 奖品: 3 日深度体验卡(每日 9.9 美元额度 ,可用 Claude 4.6/GPT-5.4 )。

- 参与: 评论区聊聊你对 GPT-6 的看法,或者你最近在折腾什么 Agent 项目,可以单独送 100 美元 GPT5.4 跑额度。

- 规则: 回帖必须带上你在ai.17nas.com 的账号 ID,不然没法充值。

相关链接: Hermes 项目: https://github.com/nousresearch/hermes-agent

作者: jiaduobao | 发布时间: 2026-04-14 16:24

45. 截至 2026 年 4 月, AI 写哪方面的代码还不行?

CRUD 、简单 app 用 AI 配合写出质量相当不错的代码

那么哪些领域 AI 写的代码还不能替代人类呢?

我所知道的,系统底层 C/C++ 用 AI 还处于乱写乱画阶段。复杂 app 用 AI 效果也不好,需要人类规划,AI 只完形填空函数实现

作者: panamera | 发布时间: 2026-04-13 03:40

46. 国内现在还有哪家量大管饱的大模型 plan 能买到

看了一圈都是售罄,国外的只能紧着用,完全不敢接到应用里。免费的 api 也都是定量,而且质量有点低

作者: superkite | 发布时间: 2026-04-12 03:45

47. 质谱赔偿我损失!

今天下午三点开始,所有的模型都不能用了! 我在一台机器上使用 zread ,结束之后,我在另外一个电脑上开始写代码。结果说我是多人使用。凭什么?我新建一个 key 不行么?有什么证据说我是同时使用的! 客户没人,凭什么!!!

作者: feelapi | 发布时间: 2026-04-13 11:22

48. 写了个 Nautilus Extension: Copy File Path

Gnome50/Debian 环境中测试通过的,方便我在 Nautilus 文件管理器中复制路径

AI 时代,软件可以按个人定制

https://github.com/wuruxu/nautilus-copypath

作者: wuruxu | 发布时间: 2026-04-13 23:20

49. 有没有什么简单的方法可以把 claude code 里用的模型 TPS 给算出来?现在越来越在意生成速度了

80 TPS 的模型和 30 TPS 的简直两个世界。前者是一个 glm 的长时间都很快

至于模型的聪明程度对我这边 spec + plan + TDD 的约束下并不是那么重要

所以不知道有什么除了肉眼以外的好方法让我测一下

现在用 cc-switch 的测试功能勉强看个大概,但也不知道是首 token 慢还是 TCP 慢还是 tokens/S 慢

作者: ClericPy | 发布时间: 2026-04-13 16:37

50. antigravity 挂了吗

没有回复了,退出登录后不能登录了…

作者: linecode | 发布时间: 2026-04-13 10:56