V2EX 热门帖子

1. Codex 改为 Token 计费了…

Codex rate card

Note: As of April 2, 2026, we’ve updated Codex pricing to align with API token usage, instead of per-message pricing. This change is applicable to new and existing Plus, Pro , ChatGPT Business and new ChatGPT Enterprise plans - please refer to the new rate card in the section below for details.

推文

留意下用量吧…(别忘了目前是临时的双倍流量)

Plus 的 5 小时用量也将被调整。

睡醒觉后 plus 用户的天塌了

作者: mikifuns | 发布时间: 2026-04-09 23:18

2. 「老板给我 5000 让我做一个淘宝」放到今天或者不远的将来有没有可能真的能实现?

等待 AI 干活时,突发奇想,当然不是要做一个“现在”的淘宝,精简点做一个拥有完整购物、支付、商品管理功能的网站。

如果各位觉得 5000 块做不出,可以预测下在当下的时间节点,哪种模型 / 花多少钱的 token 也许能做的出?

单纯图一乐的想法,觉得也许挺有趣的就发上来了,发完贴继续指挥 AI 干活

作者: cby0414 | 发布时间: 2026-04-09 14:12

3. 非 AI 相关的开源项目:断断续续写的一个可以用于生产环境源码级别调试的工具,最近又迭代了一版

https://github.com/swananan/ghostscope

这个项目有点类似于中年钓鱼的爱好,没想过有经济上的收益,也没有去蹭 AI 风口,纯属自娱自乐。不过之前由于这个项目可能太自嗨了,基本用户只有我一个人,平时工作时候,偶尔拿出来玩一玩。但是在编译器高优化选项下,程序优化的太厉害,追踪能力一直有 bug ,我就一直没有动力继续搞了。

前一阵子 gimli 库的维护者 philipc ,给我提了一个 pr ,帮我这个项目升级到了 gimli 最新版本,还顺手给我指出一个调试信息( DWARF)处理的 bug ,这让我突然又有动力继续搞起来了,至少有大佬看过我的玩具😂。

我最近除了优化了下高优化下的调试能力,包括内联函数之类的(后面我可能还会借鉴学习下 perf probe 的实现细节)。更多的是强化了这个工具的命令行模式,我本来主要想法是做成 TUI ,类似于 cgdb 那么使用的(但是 AI 时代下,我已经几个月没有用 cgdb 了,都是让 AI 给我写 GDB 脚本)。

命令行的好,AI 时代大家都懂。更方便的是,我搞了个 skill ,让 AI 来根据需要被追踪项目的源码来编写 GhostScope 脚本,也不需要用户学习 GhostScope 的脚本语法了。说实话,自研小语言,确实有点自嗨,不尊重用户(谁会去想学那些乌七八糟的小语言)。

我现在自己平时工作用的还蛮开心的,动不动指挥 Claude code 写个脚本来追踪我开发功能的细节,所以还是继续发帖来交流下。特别是想找点有共同爱好的人,可以一起打磨这个项目。目前这个项目只对 c 语言支持比较好,我后面除了基于 eBPF 的栈回溯之后,还想多支持一些 Rust 的高级语言特性,(话说要是把 async 给拿下,那就有点碉堡了,感觉工作量巨大)。

作者: swananan | 发布时间: 2026-04-09 12:43

4. 近期免费的 opus 渠道

Replit :量大管饱,有大佬已经放焚决了,可以邮箱注册,1 个号是 5 刀的额度,但是如果你免费绑个卡搞会员,然后再撤掉会员,那么就是 120 刀 x2=240 刀的额度。

Anything :开个注册机就能批量刷免费号,基本对于邮箱后缀没有要求,然后再叠加 2api 的软件,也是好用的,就是慢一点。

Accio :有额度,但是注册似乎有点困难了,对于 代理线路、邮箱后缀等都要求好严,基本就是注册机碰运气,而且还经常封号,我本地处于别注册别封号的状态,基本能维持可用,属于保底方案了。

免费白嫖 Claude 模型教程,3 分钟就能用

注册 打开 Replit 注册账号,选择 免费计划。

输入 Prompt 在首页输入下面的 Prompt ,按提示继续操作。

目标:在 Replit pnpm monorepo 中建立 OpenAI 兼容反代 API 并发布。 [环境准备] 1. 在 Replit Integrations 中添加 OpenAI 和 Anthropic AI 集成 2. 设置 Secret:PROXY_API_KEY (任意字符串,作为 Bearer Token )、SESSION_SECRET [ API Server 修改] 文件:artifacts/api-server/src/routes/proxy.ts - 创建 GET /v1/models ,返回模型列表( gpt-5.2, gpt-5-mini, gpt-5-nano, o4-mini, o3, claude-opus-4-6, claude-sonnet-4-6, claude-haiku-4-5 ) - 创建 POST /v1/chat/completions: - 验证 Authorization: Bearer ${PROXY_API_KEY},失败返回 401 - 按 model 前缀分发:gpt/o 开头→OpenAI client ,claude 开头→Anthropic client - Anthropic 需转换格式:提取 system 消息,messages 只保留 user/assistant - 支持 stream=true:设置 Content-Type: text/event-stream ,X-Accel-Buffering: no ,res.flushHeaders() - OpenAI 流:直接透传 chunk ,每块 res.flush() - Anthropic 流:将 content_block_delta 转为 OpenAI chunk 格式,每块 res.flush() - 每 5 秒发送 keepalive (": keepalive\n\n"),req.on("close") 时 clearInterval ,用 try/finally 防 500 - 非流:等待完整响应后返回 OpenAI 格式 JSON - Express body limit 设为 50mb 文件:artifacts/api-server/src/app.ts - app.use("/v1", proxyRouter) 文件:artifacts/api-server/.replit-artifact/artifact.toml - paths 数组加入 "/v1" [前端门户] 用 createArtifact({ artifactType: "react-vite", slug: "api-portal", previewPath: "/", title: "API Portal" }) 创建 artifact App.tsx 功能: - fetch(`${window.location.origin}/api/healthz`) 检测在线状态 - 展示 Base URL 、/v1/models 、/v1/chat/completions 、API Key 说明 - 复制按钮 - CherryStudio 4 步设置指引 - 模型列表 - 深色主题 [发布] - 启动两个 workflow:api-server 和 api-portal - presentArtifact({ artifactId: "artifacts/api-portal" }) - suggestDeploy() - 发布后域名即为 CherryStudio 的 Base URL

- 填写 API Key 创建过程中会弹出窗口,让你填写 API Key 。 这个 Key 需要自己创建,并且一定要保存好,后面不会再显示。

- 获取地址 创建完成后,会显示一个接口地址,例如:

https://xxx--username.replit.app

Base URL:上面的地址API Key:你刚才填写的那个 Key

作者: kevin96 | 发布时间: 2026-04-08 02:17

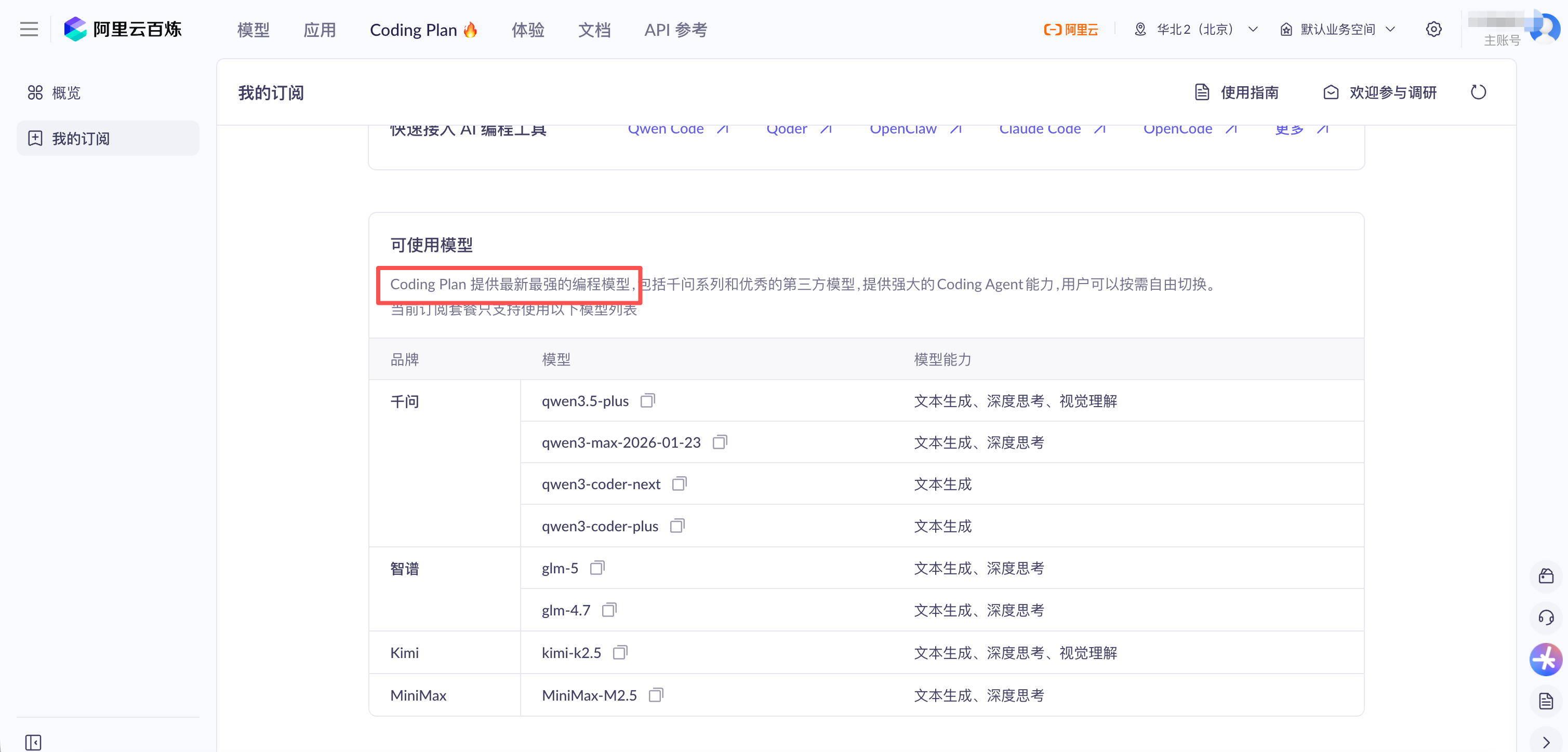

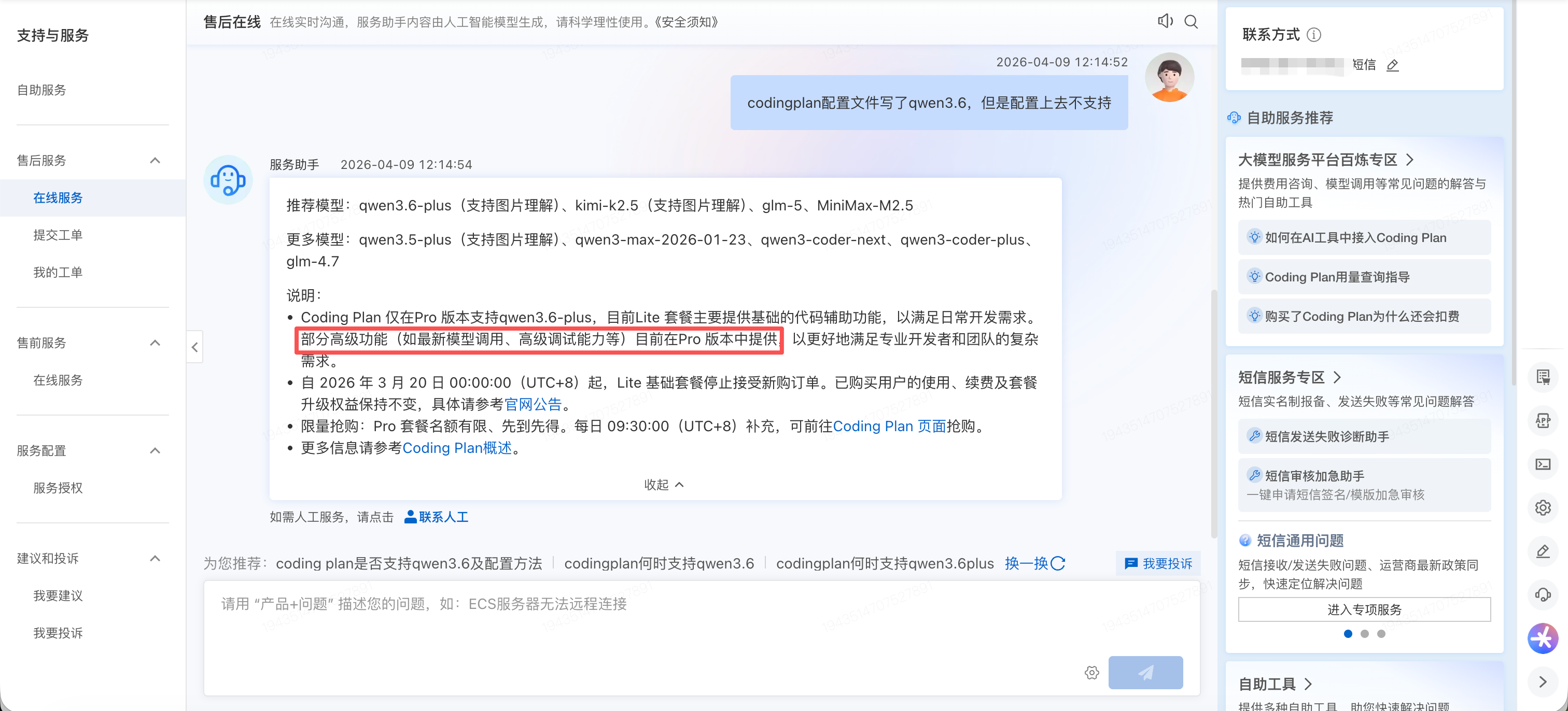

5. 阿里云 Coding Plan 怎么感觉有点虚假宣传的味道了

买之前:Coding Plan 提供最新最强的编程模型

现在:部分高级功能(如最新模型调用、高级调试能力等)目前在 Pro 版本中提供

我觉得你写个灰度发布都比直接在那分等级好吧,买的时候你可没在那区分,现在想起来了吗,还是我记忆错乱了

作者: kincaid | 发布时间: 2026-04-09 04:20

6. 国内哪个云厂商的服务器便宜好用。

最近搞了很多东西,想部署到云上,快速试错,无奈那些云厂商价格并不美丽。

站里有代理吗?

作者: doanything | 发布时间: 2026-04-09 01:25

7. Claude 5x 完全不够用

同时后端 + App ,3 个小时不到额度就耗完。

作者: alfa | 发布时间: 2026-04-09 16:23

8. Vibe 了一个 APP,用于根据 WiFi 状态切换 🪜

用 Android 的时候一直有个痛点:公司和家里的 WiFi 都是全局 🪜 的,但用蜂窝网络的时候要在手机上打开相应的 APP 才行。

我希望能实现:连接 WiFi 时候自动关闭,断开 WiFi 时候自动打开,实现 24 小时🪜。找过一些 Android APP 都达不到想要的效果(其实 iOS 上有很多 APP 都自带了这个功能)。

所以尝试自己折腾了一个:点这里。

因为公司和家里的 WiFi 都是全局的,所以暂时没有做针对特定 SSID 的判断。用 Shizuku 是为了解决锁屏也能工作的问题,然后也因为从自己的需求出发,暂时只适配了 Clash Meta for Android 。😂

目前在小米和三星上都跑通了,其他没测试过,也请大佬们提提意见。

作者: pricky777 | 发布时间: 2026-04-09 03:18

9. 预算 2 千给父母买个手机求推荐

打算给父母买个手机,预算 2 千,大家有没有推荐?

作者: wqlken | 发布时间: 2026-04-08 05:58

10. 在 Token 消耗上, 2 个空格比 4 个空格缩进更省吗?

不是 Tabs vs Spaces 的圣战,是用 AI 之后,代码缩进转化成 Token 的问题。

AI 的解释是:

2 个空格可能被识别为 1 个 Token 4 个空格也可能被识别为 1 个 Token 但如果层级很深,差距越大: 2 空格缩进:第 4 层 = 8 个空格(约 2~4 个 Token ) 4 空格缩进:第 4 层 = 16 个空格(约 4~8 个 Token )不知道是不是火星了,如果是讨论过的话题请告知。

作者: civet | 发布时间: 2026-04-09 05:57

11. 阿里云 Coding Plan 新增了 qwen3.6-plus 模型

刚发现 Coding Plan 的可用模型列表更新了 qwen3.6-plus 。

顺手写了几个 prompt 测了下,效果确实不错。有在用这个套餐的 V 友可以切过去试试水。

作者: jonsmith | 发布时间: 2026-04-09 03:07

12. OpenRouter 的 claude, gpt 不能用,报错说违法协议,你们的呢?

The request is prohibited due to a violation of provider Terms Of Service.

作者: think9999 | 发布时间: 2026-04-09 09:26

13. 京东的 coding plan 限速太严重了,想买的慎重

上个月月底看到京东也推出了 coding plan ,而且支持 GLM 5 ,首月 7.9 ,用量也很大,每五小时 1200 次请求,一个月总 18000 次请求,看起来不要太香。

于是我赶紧抢了一个,刚开通第一天,就频繁 429 rpm limit ,基本上每个请求都在 429 ,根本无法正常使用。

提了个工单,技术人员回复说是因为刚推出,用的人太多了,负载太高,他们已经紧急扩容了,让我再试试。

提完工单后几天确实没有 429 了,但是也就撑了几天,现在确实不报 429 了,开始频繁报 400 Decode server is overloaded ,也是基本正常几个请求就会出现一次。

429 都还好,Claude Code 会自动延时后重试,400 Claude Code 就直接终止会话了……

另外,即使不出现 429 或者 400 ,这个套餐用量也是不可能用完的,因为响应速度非常慢,慢到令人发指……

作者: admin948 | 发布时间: 2026-04-09 05:43

14. claude code 究竟怎么才能稳定存活?还有啥替代品?

cursor 现在的订阅模式按 token 计费,$20 的订阅 token 一天就没了。想换 claude ,研究了半天看老哥们说用美区 app store 礼品卡订阅,礼品卡都买好了,下了 claude 用谷歌登录直接被封……甚至还没看到订阅按钮。

有其他老哥说用 GLM5.1 ,结果这玩意儿直接上限流限购丝滑连招。

其它模型跟 opus sonnet 差距还是有点大,有没有长期稳定使用 cc 的老哥分享下自己的网络(自建 VPS ?机场?)和支付方式(海外银行卡? app store 订阅?)?

鉴于我刚登录就被封了,如果有老哥能分享下登录用什么渠道也很感激……

作者: rookie9527 | 发布时间: 2026-04-09 07:37

15. “本地优先” 与 CRDT

在组织一个”本地优先”的交流群,在帖子里看到 @henix 问,”什么叫’本地优先’,跟 self-hosted 软件有关吗?”

这个问题想了一下,发现解释起来很复杂,需要理解”本地优先”最精髓的点。 两个概念确实相似——共同的敌人是百度腾讯阿里 Google Apple Meta ,它们提供了服务,也顺带垄断了用户的数据;两个概念也允诺同一种理想——自我控制、自给自足、简单稳定的数字生活。没有人希望被企业随意打扰侵入,都希望拥有主动权,享受数字世界的好处,又不被巨头玩弄注意力。

最简单区分两个概念的方式——数据在哪里?

可以离网运行的软件,例如 Git 和 Obsidian ,它们在自己的计算机本地运行,这是一类。但本地优先与本地运行的软件并不相同。自托管(self-hosted)是 VPS 或 NAS 是自己的,上面跑一些应用,自己通过客户端来使用,数据本体在云上。本地优先是数据本体存在自己的手机或电脑上,云端最多用于同步和备份。自托管与本地优先也不相同。

“本地优先”是一个技术运动,它允诺了一种新的软件理想原型。本地优先应用是一种构建软件的方式,既支持实时协作(如 Google Docs ),也支持离线工作(如 Git )。其原理是将用户数据存储在本地设备上,并在后台与协作者同步。如何合并在不同设备上独立进行的编辑是核心挑战,CRDT (无冲突复制数据类型)正是为解决这个问题而开发的。

这个问题非常好玩,值得多写一些来解释清楚。下面会讲讲历史和它的理想。

历史

要理解本地优先想做什么,绕不开 Ink & Switch 这个实验室。

V2EX 上有人翻译过《本地优先软件》,已经很好了。更详细的信息,可以跟 AI 唠唠。

2019 年,实验室的合作者 Martin Kleppmann 等人发表了论文”Local-first software: You own your data, in spite of the cloud”,正式提出了本地优先的概念。核心论点很简单:把云应用中”服务器数据为权威、客户端仅为缓存”的模型翻转过来——用户设备上的数据副本才是主副本,服务器只负责同步和备份。由此推导出一系列理想:无需等待、网络是可选的、无缝协作、数据长期留存、用户保有最终控制权。

Martin Kleppmann 是《数据密集型应用系统设计》(豆瓣评分 9.6 )的作者,现任剑桥大学副教授。Automerge 最初的理论基础和算法设计都来自于他。Automerge 的核心维护者 Orion Henry ,也是实验室的三位创始人之一。

实验室本身,要从 Heroku 说起。2010 年 Heroku 被 Salesforce 收购后,联合创始人 Adam Wiggins 、James Lindenbaum 和 Orion Henry 在 2015 年重聚,成立了 Ink & Switch 实验室。Peter van Hardenberg ( Heroku Postgres 的创建者)于 2016 年加入,2020 年成为实验室主管。团队一开始并不知道要做什么具体产品,而是先思考一个根本问题:”计算到底应该怎么服务人?”这种从理念出发的方式,决定了后来 local-first 的走向。

Ink & Switch 不做面向市场的产品,而是先提出理念,再围绕理念做技术探索和原型验证,产出论文和可运行的实验性原型——这些原型会成为其他人做产品的想象力来源。类似于当年的 PARC 实验室发明了图形用户界面和以太网。

理念背后有一种朴素的直觉:不会有多少普通用户愿意自己跑一个服务器来掌控数据,那为什么不让用户自己的设备就是数据存放的地方?思路很自然,但最难的问题随之而来——当多台设备各自修改同一份数据,冲突怎么解决?

这里有一个有趣的反转。本地优先的目标是让软件摆脱对服务器的依赖——数据在本地,协作走点对点,服务器不再是必需品。而提出这个理念的人,此前十年做的事情恰恰是让所有人把应用和数据交给服务器。Heroku 是最早的云平台之一,开创了”git push 即部署”的体验。Peter van Hardenberg 在 Heroku 从零搭建了托管 PostgreSQL 服务,比 Amazon RDS 支持 PostgreSQL 早了三年。这种转变原因很简单——服务器-客户端模型并不是用户想要的。数据在别人的服务器上,离线就没法用,服务商关了数据就没了。

于是,建造云的人转身要摆脱云。

CRDT

云应用给了我们协作,传统软件给了我们数据所有权,能不能两个都要?把数据放回本地之后,核心难题就一个:两个人各自在本地改了同一份文档,没有服务器做裁判,怎么合并?

现有工具的处理方式往往是生成一个冲突副本,或者把冲突文档丢进一个专门的文件夹,让用户自己想办法。这不是解决方案,而是把问题转嫁给了用户。

CRDT ( Conflict-free Replicated Data Type ,无冲突复制数据类型)的思路是从数据结构层面让冲突不可能发生。

举一个最简单的例子。假设几台设备要统计同一件事的发生次数,做法是:每台设备只递增自己的计数器,同时保存其他设备的计数值,总数等于所有设备的计数之和。因为每台设备只改自己的那一格,不碰别人的,根本不存在冲突。无论各设备以什么顺序同步,最终结果都一样。

这就是 CRDT 的核心直觉:不是在冲突发生后去解决它,而是把操作设计成怎么组合都不会冲突。在数学上,这要求并发的操作满足交换律——不管谁先谁后,结果一样。需要注意的是,CRDT 提供的不是完美的实时一致性,而是”强最终一致性”:两个副本可能暂时不同步,但只要同步过消息,就一定会达成一致,不需要人为介入。

计数器只是最简单的情况。要在文本编辑、列表排序、树形结构上实现同样的无冲突合并,复杂度要高得多。

目前比较成熟的开源 CRDT 库有Automerge、Yjs、Loro。

关于 CRDT 更详细的介绍,推荐读陈子轩的《 CRDT 简介》以及他的博客,他是 Loro 的维护者。

CRDT 历史

在 CRDT 之前,协同编辑的主流方案是 OT ( Operational Transformation ,操作变换),1989 年由 Ellis 和 Gibbs 提出,Google Docs 至今仍在使用。OT 的思路是由一台中心服务器对并发操作进行变换来保证一致性,在有中心服务器的场景下运行良好。但要让它在去中心化环境下工作,异常困难。

CRDT 的学术理论脉络可以追溯更早。2006 年,Oster 等人发表了 WOOT 算法,是最早的协同文本编辑 CRDT ,虽然当时还没有”CRDT”这个名字。2011 年,Marc Shapiro 等人正式提出了 CRDT 的定义,将其分为 State-based 和 Op-based 两类,并给出了数学证明。

理论框架早已建立,但工程实现充满挑战。

几个关键问题:数据膨胀 ——最朴素的做法是每个字符带一个全局唯一 ID 加上因果关系元数据,1KB 的文档可能需要 100KB 的元数据。数据回收 ——CRDT 通过只增不删来保证无冲突合并,但这样数据永远膨胀,早期一个 10 万字且经过大量修改的文档能吃掉 800MB 内存。排序问题 ——在同一位置并发插入字符时,如何让数学操作与用户意图保持一致?早期 CRDT 算法可能把”hello”+”world”逐字符交错成”hweolrlold”。还有更多问题:单一数据类型的 CRDT 不难,但一个文档里同时包含 map 、list 、text 多种格式呢?每种格式的语义、多种格式的交互都很复杂。再比如一个长期离线的节点突然上线,带来巨量历史操作,如何处理?测试也困难重重,很多 bug 需要极其特殊的条件才能触发。

Automerge 记录了自己早期版本的性能:一篇学术论文的完整编辑过程,最终文档约 10 万字符,共产生约 26 万次插入和删除操作。由于早期 Automerge 将每次单字符编辑都存为一条独立的 JSON 操作记录,每个字符带来约 240 字节的元数据开销,序列化后文件体积膨胀到数十 MB ;回放前 10 万次操作就需要 43 秒,在约 23.5 万次操作时便耗尽了 Node.js 默认的 1.4GB 堆内存而崩溃,根本无法完成全部回放。这正是后来 Automerge 2.0 用 Rust+WebAssembly 重写并引入列式二进制编码的核心动因。

今天另一个 CRDT 库 Loro 展示了这个领域的最新进展。Loro 用 Rust 编写,2024 年 10 月发布 1.0 ,在同一条 26 万次操作的基准测试中,Loro 的回放耗时约 176ms ,文档体积为 128KB ,并且 Eg-walker 算法允许已同步的历史操作被安全回收,缓解了早期 CRDT”数据只增不减”的根本问题。Automerge 也在进步,120 万字符的白鲸记,纯文本大小 1.2MB ,Automerge2.0 时内存占 700MB ,Automerge3 内存占 1.3MB 。一个有大量历史的文档,旧版 Automerge 加载超过 17 小时都无法完成,3.0 只需 9 秒。

上文的性能数据只提到了 Loro 和 Automerge ,但如果追溯历史,三个库各有侧重。Yjs ( GitHub 21k+ star )最早把 CRDT 做到了工程可用,生态最成熟; Automerge ( GitHub 6k+ star )从学术出发,追求通用的数据模型和完整的版本历史; Loro ( GitHub 5k+ star )最年轻,试图兼取两者的长处,性能最好。三个项目恰好勾勒出这个领域十年来的演进。

Kevin Jahns 在德国亚琛工业大学读书期间开发了 Yjs ,2015 年发表论文。他设计的 YATA 算法,核心创新是用扁平链表而非树结构来表示文档,大幅降低了计算开销,性能长期领先于同期的学术实现。但 Yjs 的设计聚焦于列表和文本——如果数据是复杂的嵌套结构,就需要自己想办法映射。目前 Yjs 生态最成熟,GitHub 超过 2 万 star ,Jupyter Notebooks 的协同编辑就基于 Yjs 。

Automerge 走了另一条路:让 CRDT 支持任意嵌套的 JSON 结构。2017 年 Ink & Switch 与 Martin Kleppmann 合作启动了这个项目,理论基础是 Kleppmann 同年发表的论文”A Conflict-Free Replicated JSON Datatype”。Automerge 还完整保留文档的编辑历史,支持类似 Git 的版本回溯和分支。代价是早期纯 JavaScript 实现非常慢,Kleppmann 自己说过,最初的版本”极慢,还有 bug”,只是研究质量的软件。2020 年起团队用 Rust 重写后端,性能问题才逐步解决。

Loro 出现在 2023 年,由陈子轩创立。它试图同时解决前两个库各自的短板,技术基础来自 Joseph Gentle 提出的 Eg-walker 算法——没有并发编辑时开销接近 OT ,有并发时才启动 CRDT 的合并逻辑。Eg-walker 允许已同步的历史操作被安全回收,缓解了早期 CRDT”数据只增不减”的根本问题。在文本编辑上,Loro 整合了 Fugue 算法来解决交错异常,并在此基础上开发了自己的富文本 CRDT 算法。

理想

一言蔽之,本地优先不是关于把数据放在哪里的产品理念,而是一种新的软件架构。

这种架构的可贵之处在于对云的最小化依赖。服务器可以扮演端到端加密的存储与同步角色,但无法查看用户的内容。这从根本上改变了安全模型——即使服务器被攻破,攻击者拿到的也只是加密数据,平台大规模数据泄露的问题因此得到缓解。

在 AI 时代,网络攻击的成本在降低。也许我们会去到赛博朋克 2077 里的世界——AI 成为攻击的手段,赛博空间的全面战争爆发。如何储备相关的技术,把把流窜的恶意 AI 行为,挡在没有被 AI 摧毁的残存网络之外,就是一个很有趣的科幻故事与未来问题了。

不只是本地优先。GNU/Linux 和各类 FOSS 工具链、端到端加密协议、与密码学支持的各种安全交互、多样小型的新网络协议栈实验、手机中的 SE…这些技术的发展共同允诺了一种可能性:从云退回到本地,重新想象数字世界的样子。

虽然不知道它会走向何方。但至少它对个人更友好,也限制了平台的能力。至于是否会让社会变得更美好,与技术无关,取决于每个人的道德与努力——让这些技术不被扭曲。

作者: soochowgreen | 发布时间: 2026-04-07 06:27

16. 根据我自己的日常查词习惯做了一个英汉字典 GPT,欢迎尝试

https://chatgpt.com/g/g-684aa6ade9b88191849d27b5df199ebc-english-to-chinese-dictionary

作者: Livid | 发布时间: 2025-06-12 10:15

17. 拼夕夕百亿补贴-购买 m5 pro 或 air 建议

各位大佬,目前在用的 2015 年 macbook pro ,有点跟不上趟了,想更新下。

现在 m5 的 air 也是视网膜屏,查了下参数对比 pro 有些 diff

主要差距:

屏幕 500 尼特 & 1000 尼特亮度 60HZ & 120Hz 有无风扇 air 更轻便,缺点是无法锻炼麒麟臂各位大佬,有更新 m5 mac 的吗? 10 年一换,还用等等最新款吗?好久没关注电脑了。

作者: csfreshman | 发布时间: 2026-04-09 08:53

18. 请教大家,关于无障碍权限每次冷启动之后都需要授予的情况有方法绕过么?

在做一款 GUI 相关的 app ,使用无障碍来执行一些点击操作 技术路线其实跟李跳跳差不多 但遇到的问题是,每次杀掉应用重进,都得再重新授予一次无障碍权限 太麻烦了 我安装李跳跳发现并不需要,即使杀掉应用,李跳跳的无障碍权限也是开着的,我的手机也没有 root 请教各位大佬,这个是如何实现的啊

作者: lixyz | 发布时间: 2026-04-09 11:23

19. 咱们这一辈,真可能是最后一代人类程序员了!

Claude Mythos vs Claude Opus 4.6

SWE-bench Verifed:93.9% – 80.8%

SWE-bench Pro:77.8% – 53.4%

SWE-bench-Multilingual:87.3% – 77.8%

SWE-benchMultimodal:59% – 27.1%https://www-cdn.anthropic.com/53566bf5440a10affd749724787c8913a2ae0841.pdf

作者: qxmqh | 发布时间: 2026-04-08 06:25

20. 百度千帆 coding plan 上新模型了

模型名叫:

ERNIE-4.5-Turbo-20260402

作者: lynn1su | 发布时间: 2026-04-09 06:38

21. [英语作文题·2026 年出海卷] 假如你是独立开发者李华,写一篇问候信 Tim Cook 并告诉他你最新受到 AppStore 审核的不公正待遇.

[英语作文题·2026 年出海卷] 假如你是独立开发者李华,写一篇问候信 Tim Cook 并告诉他你最新受到 AppStore 审核的不公正待遇.

claude 让我写信给 tcook 告御状,我来试试看. 顺便过来水一帖. 天杀的苹果审核沙雕,vibe coding 来了以后日子一定很艰难吧. 打工人何苦为难打工人.

[高考英语作文题·2026 年出海卷]

假如你是独立开发者李华,开发了一款画画 App,约 1 万用户. 最近 iPad 严重 bug,用户打开画布直接白屏. 你连夜修好了,提交苹果审核然后被傻福苹果连拒 5 次.

AI 说给 [email protected] 写信会有所帮助. 请根据以下材料,给苹果 CEO Tim Cook 写一封不超过 500 字的英文求助信。

第一轮

苹果:Apple 登录按钮 Sign in with Apple 点了没反应啊. 李华:(是不是 test sandbox 的苹果 id 问题?)后台日志零报错,我 discord 和 qq 群都问过了.用户天天登没问题,本地版本我也截图录屏给你看了. 社区也有反馈 bug,要不您看看? 苹果:我开水果摊的,能不知道有没有问题? 李华:好的哥,我照做,我暂时把入口关了,先排查. 您先看能不能过审我们的功能修复.

第二轮

苹果:你这个 Google 登录怎么跳到外面浏览器了,你这跳转流程有问题啊? 李华:好的我这就改,我暂时隐藏.(测你码其他那么多大 app 都 safari 跳转你不管来管我).

第三轮

苹果:用户登录不了啊. 给你机会你不中用啊. 李华:???发帖我们暂时维护不行吗?!而且你让我隐藏的关的啊??? 苹果:反正登录不了. 2.1. 就是 2.1. 李华:行……我放个”功能维护中”的提示. 爸爸,您瞧,这样行吗?

第四轮

苹果:用户还是登录不了,你这怎么能叫社区呢? 李华:爸爸收了神通吧.我不要 comment 了行么,我把登录整个删了,匿名直接能评论了. 苹果:简介里写了”Community”,不准确,达咩. 2.3 送上. community 有问题啊. 李华:我这 App 能发画、能投票、能看别人的作品,不叫社区叫什么?叫我燥称冯了个福马克嘛?司马苹果我求求了.

第五轮

📌 补充信息:

- iPad 用户已经一个多星期画不了画

- 德国老哥发邮件问”这 App 是不是要倒闭了”. 可怜的李华,被玩弄于股掌之间

- 1 星差评/抱怨信开始进场

- 补丁就躺在那里,发不出去.

- 先 appeal,然后已经开始给 Tim Cook 写邮件了

刚刚发生在我身上的真实经历,不存在夸张.

独立开发者每天都在和傻福苹果斗智斗勇.bug 修好了发不出去.眼睁睁看差评进来.

我燃尽了. 再不抱怨宣泄会疯的.

作者: unibrighter | 发布时间: 2026-04-09 11:10

22. Happy Horse: Seedance 2.0 killer

Happy Horse-1.0 is the world’s #1 AI video generator (Elo 1333 on Artificial Analysis). Come create cinematic, realistic text-to-video and image-to-video with unmatched motion quality.

作者: ttt1088 | 发布时间: 2026-04-09 11:27

23. 似乎在 C 的领域,让一个新程序“为未来准备好”是一件很麻烦的事

最近在修改一个 C 的开源小项目。因为是想在 Win 下用的,但项目是用 autoconf 构建的,所以准备了 MSYS2 UCRT64 环境来开发。然后就踩了处理不了大于 2G 文件的坑(用了 fstat)。虽然说就是一个 _FILE_OFFSET_BITS 宏的事,但毕竟是个跨平台项目,所以就查了下主流系统下这个问题的支持情况,感觉好多槽点。

- MSYS MinGW-w64 默认提供 32 位 off_t ,哪怕你在编译 64 位程序,想用需要上面的宏,但这并不是 POSIX 标准化的东西

- autoconf 有一个 AC_SYS_LARGEFILE 可以自动判断是否需要定义宏,但 autoscan 没提示需要这个

- 如果是 32 位 target ,似乎默认提供 32 位 off_t 是天经地义的

- 不想跟环境打哑谜的可以用明确 64 位的方法,例如 fseeko64 fstat64 ,但这玩意并不普遍可用,还是要构建系统检测。 例如老版本 android 就不支持。bionic 的文档说一大堆考量,结果就是想解决你得用较新的 ndk ,放弃支持旧版 android ,或者就放弃支持 32 位 abi 。(所以实际上哪怕是 arm64-v8a 的 android 系统依然有机会在处理大文件时出问题)

- 哪怕你不关心文件大小也可能被影响,例如查个文件创建日期就要用到 fstat ,尽管觉得做的事跟大小无关但就是有影响

- 如果在 abi 边界用了这些带 off_t 的变量/struct ,显然会出现 abi 不兼容问题,你也不知道一个第三方库可能用哪种配置

个人觉得 2GB 以上大文件并不是什么很罕见的用例,为什么开发环境就不能默认支持这些情况呢,难道还影响兼容性?

标题里的“为未来准备好”是指,只使用跨平台的 C/C++,加上 2000 年后的 POSIX:

- 已解决 2038 问题

- 除非明确要求,否则文本存储和 IO 都是 UTF-8 且不使用 wchar_t

- 无论环境如何都能正确在 ui 或控制台输出非 ASCII 字符

- 不拒绝使用 IPv6

- 支持长路径

- 保持对近十年出厂的系统和硬件的支持

似乎要在无第三方依赖的情况下做到这个是很困难的事?

作者: jim9606 | 发布时间: 2026-04-08 18:34

24. cursor 如果不开 pro,想用自己买的 codingPlan

不开只能用 auto ,怎么办

作者: sanacmilan | 发布时间: 2026-04-09 09:37

25. 腾讯云更新镜像的速度这么慢的么?

Debian13 发布都快 1 年了 腾讯云还没适配上

什么时候能上啦,再不适配就要转阿里云了。

阿里云家 Debian 13 都好几个镜像版本了

作者: acshiryu | 发布时间: 2026-04-09 07:45

26. 大家说的 claude 封号,是发生在什么时候?

目前我有 claude 账号,桌面也安装了 claude app ,但是没有充值。大概用了半年了,账号目前还好。想问下:

大家说的封号,是充值之后用 claude code 才封的账号,还是直接用 cluade 就会封账号?

作者: liulixiang1988 | 发布时间: 2026-04-09 03:03

27. 找美国当地人开号,能赚钱不

当地人被封,能不能退款?

作者: Rrrrrr | 发布时间: 2026-04-09 09:47

28. 爬虫开发工作中,你们是如何基于 AI 进行提效的?

各位彦祖,由于公司给出了 AI 提效的压力,想请教一下各位,在爬虫开发工作中,是如何基于 AI 进行提效的,希望能深入一些。

作者: KingZZZZ | 发布时间: 2026-04-09 03:09

29. 为什么 RSA 证书在新版 OpenSSH 上认证失败? russh 库 0.59 协议编码的两层坑

最近在做一个基于 Tauri + Rust 的 SSH 终端客户端(OxideTerm),底层 SSH 协议用的 russh 。这周修了一个比较有意思的兼容性 bug ,涉及 RSA SHA-2 认证在严格 OpenSSH 配置下的三条路径,记录一下排查过程。

问题

有用户反馈 RSA 私钥在某些新部署的服务端上登不上。让 AI 排查后发现不是单点故障,而是 RSA SHA-2 相关的三条认证路径都有问题:

- 普通私钥认证

- SSH Agent 认证

- OpenSSH Certificate 认证

根源是同一件事:OpenSSH 8.2+ 默认禁用 ssh-rsa ( SHA-1 ),只允许 rsa-sha2-256 / rsa-sha2-512 。客户端如果还在用旧的算法名或者协商逻辑有漏洞,严格服务端直接拒。

私钥和 Agent:相对直白

私钥路径 :没有根据 server-sig-algs 做正确的 RSA 算法协商。修复后按 sha2-512 → sha2-256 → ssh-rsa 的顺序尝试,服务端不让继续就停。

Agent 路径 :调 russh 的认证 API 时 hash_alg 传了 None ,等于放弃了 SHA-2 协商。修复策略一样——RSA key 走 SHA-2 顺序尝试,区分 transport error 和 sign error ,前者立即返回,后者换算法重试。

Certificate:这才是有意思的部分

russh 0.59 暴露了

authenticate_certificate_with(cert, hash_alg, signer)这个 API 。第一反应是把 hash_alg 传进去就行了?不行。

hash_alg 确实能控制 signer 用哪个 hash 算法签名,但 russh 在把证书认证请求编码发给服务端 的时候,外层的算法名仍然写死了

[email protected]。真实 OpenSSH 的行为是:先看外层算法名,不对直接拒,根本不看你签名用了什么 hash 。

客户端: "我要用 [email protected] 认证" 服务端: "这个算法我不认,拒绝。" 客户端: "但是我里面用的是 SHA-256 啊!" 服务端: "我不管里面是什么,外面名字不对就不行。"正确的算法名应该是

[email protected]或[email protected]。

修了一层,又来一层

确认外层算法名是问题后,vendor 了一份 russh 0.59 做最小补丁——只改证书发包路径的算法名编码。

改完跑真实 OpenSSH 测试,probe 阶段通过了。

但最终签名请求又挂了 ,OpenSSH 日志:

parse signature packet: unexpected bytes remain after decoding不是算法名的问题了,是签名包格式 有问题。

russh 的自定义 signer 协议要求返回值不是「裸签名」,而是「原始 to_sign buffer + 追加一个 length-prefixed signature blob 」。本地证书 signer 只返回了编码后的签名本体,少了前面的原始数据,OpenSSH 直接按格式错误处理。

对照 russh agent signer 的实现确认了这个协议约定后,修正了返回格式。

验证

我没有让 AI 只写 mock test 就收工,因为我怕还是有问题,于是让 GPT 写了一组真实本地 OpenSSH 集成测试 :

- 本地启动真实

sshd+ssh-agentssh-keygen生成真实 RSA key 和 user certificate- 分别对服务端施加

rsa-sha2-256-only和rsa-sha2-512-only限制

路径 rsa-sha2-256-only rsa-sha2-512-only Agent ✅ ✅ Certificate ✅ ✅ 为什么坚持用真实 sshd ?因为这次的两层 bug——算法名编码和签名包格式——在 mock 环境下根本不会触发,只有在真实二进制流交换时才会暴露。

叠甲:为什么 vendor 而不是提 PR

- russh 的维护节奏和项目不完全同步,等上游合并发版时间不可控

- 补丁只改了一个函数的算法名编码,diff 不到 30 行

- 问题只有在严格限制

PubkeyAcceptedAlgorithms的真实 OpenSSH 上才能复现- 用

[patch.crates-io]引用本地 vendor ,上游修了随时切回

这个 bug 影响谁

如果你的服务端是这几年新部署的,或者手动加了:

PubkeyAcceptedAlgorithms rsa-sha2-256,rsa-sha2-512那么任何基于 russh 0.59 做 SSH Certificate 认证的项目理论上都会踩到。不只是我们的问题,russh 本身在证书路径上的协议编码就有缺口 。

对了,这是我们的项目,有兴趣的话也可以看看

项目地址: https://github.com/AnalyseDeCircuit/oxideterm

后续想法 :打算把技术周记做成系列,手头积攒了不少坑。大家有兴趣的话我再发点?

作者: pierreoui12 | 发布时间: 2026-04-09 13:40

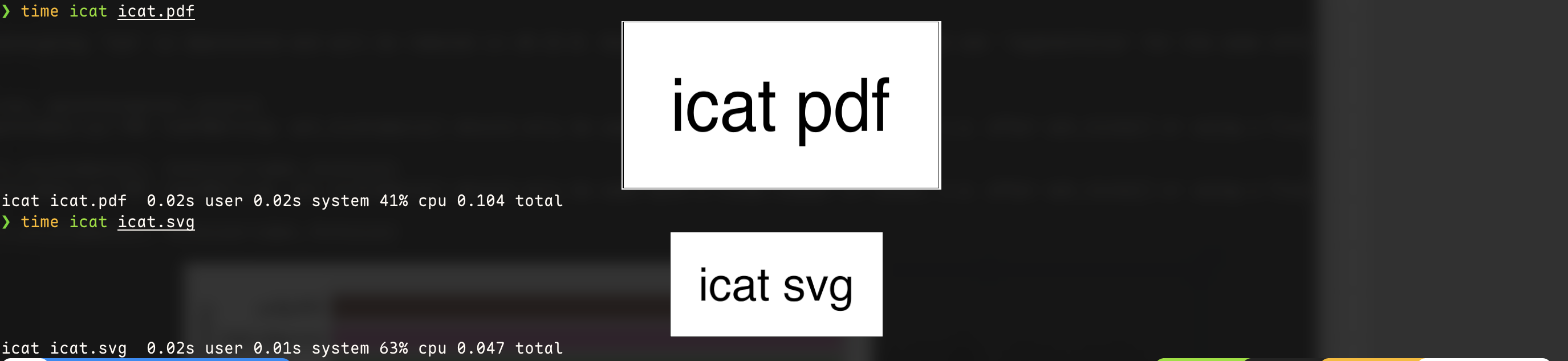

30. 推荐个终端图片预览工具: 支持 jpg, png, svg, eps, pdf 等格式

Github 地址: https://github.com/Rhythmicc/icat

这个小工具用 C++ 实现,花半天 vibe coding 出来的,支持 iTerm2 、Kitty 和 Ghostty 终端,相比于 Python 版本的实现能快 6.5 倍。

作者: rhythmlian | 发布时间: 2026-04-09 09:42

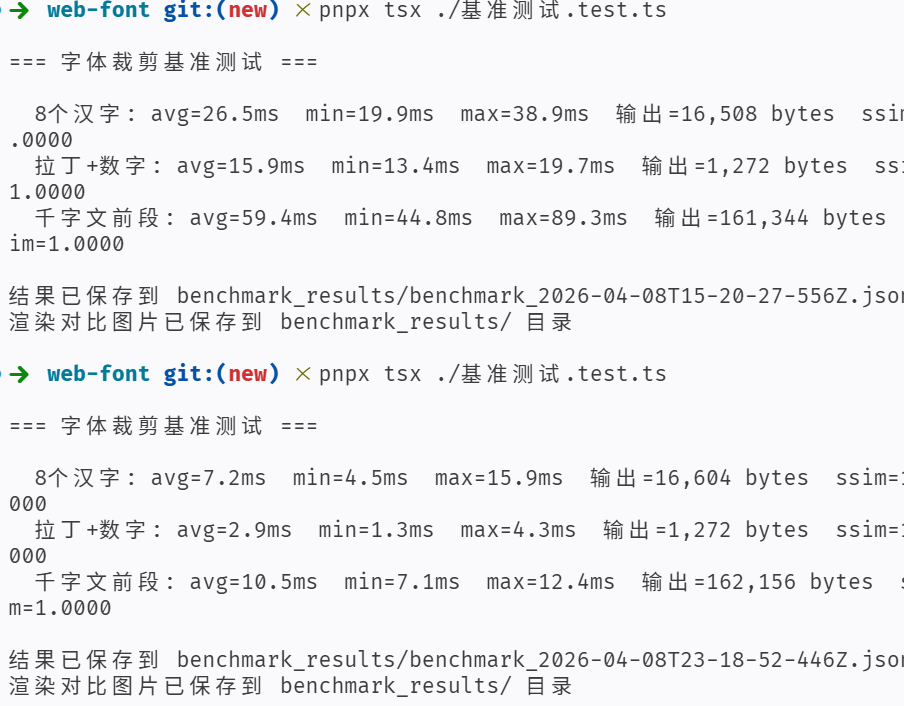

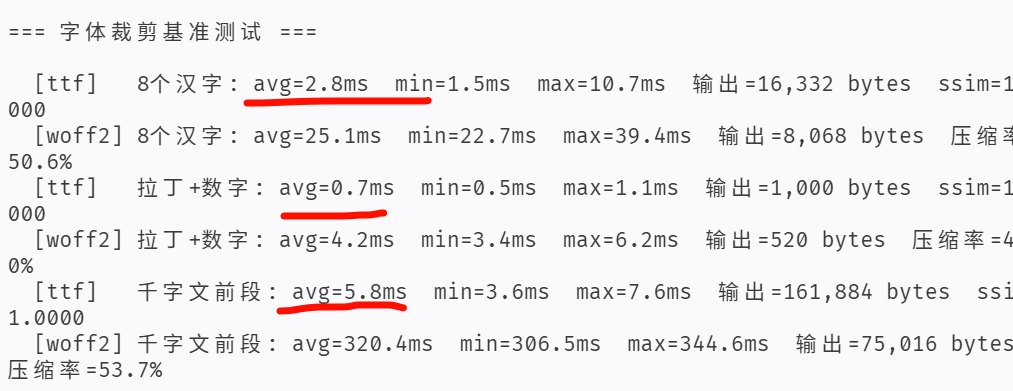

31. cc loop 模式自动优化代码性能实战

背景

今天呢就是又遇到了字体需要裁剪的情况了,做前端就是难免逃不掉和字体去打交道。

时隔几年又碰到需要裁剪字体,想起来多年之前手搓的字体动态裁剪工具,但是现在用起来不是特别好用。

让我自己改嘛,我又没什么兴趣改了,所以的话,我就想要让 AI 帮我改。

AI 改的时候有种被玷污的感觉,但是我自己又不想维护,就是还是让 AI 帮我改吧

很快啊,他就帮我把整个界面重新写了一遍,还新增了一些上传下载功能,这些功能其实我一直想要,但自己一直不想去改。

然后我又突发奇想,因为咱们这个项目本质上是依赖开源的一个字体编辑项目,那我在想,因为咱们性能虽然很快,但是不够快,我想让 AI 试试看,它能不能直接从底层去优化这个性能。

所以我让他直接把那个包拉到项目本地,然后让 AI 去优化。

实践

昨天晚上让 glm-5-turbo 自己跑了一晚上优化,今天早上被震惊了,ai 是真厉害啊

将一个成熟的开源库的性能居然能优化快了足足接近十倍多了,太强了

作者: llej | 发布时间: 2026-04-09 09:18

32. 想听听 GLM5 的使用感受

各路大佬们,在用 GLM5 (尤其是用智谱自己的 coding plan 的用户)

想跟大家请教下各位的使用体验,尤其是中小项目的 vibecoding 选手。

我没抢到官方的订阅,所以入手了腾讯的 coding plan ,用了一个月了,我发现个问题

腾讯的 plan 里面其他模型啥事没有都挺正常的 ,只有 GLM5 这一个模型,很傻

vibecoding 里很多时候都要模型自己想自己调工具,一条的上下文会长点甚至要压缩,

但是 GLM5 官方宣称 200+k 上下文,我配置也按腾讯官方的配置文档走的,

实际使用中,100K 左右时就开始出现包括但不限于:死机(反复复读)、失语(输出乱码)、失忆(不会调用工具,思考链疯狂输出代码)、背叛(开始疯狂输出不知道哪来的问题的回答…驴唇不对马嘴)

这个问题我已经开工单在调查中,但是鉴于网上没见过有人吐槽这个问题以至于我都怀疑是不是我一个人克这个模型,

我虚心向各位大神请教各位在使用 GLM 模型(尤其是 GLM5 )过程中是否存在以上问题。

如果不存在,我会去 试着抢一下智谱的 plan ,但我现在就怕智谱自家都这样…那就浪费时间了。

跪谢大佬们抽时间回复…ORz

作者: mikifuns | 发布时间: 2026-04-08 08:39

33. 看到不少 V 友点 star,正式发下自己总结的 AI’白皮书’,欢迎大家提意见

昨天在别的帖子里发了下链接,发现有不少 V 友点 star

https://github.com/Mzs-code/ai-wiki

最近公司有培训业务/运营/项目同事使用 AI 的需求

就总结了一下过去 1 年对 AI 使用的理解

写了一个偏培训场景的’白皮书’,包含一些生动的说明图片

有原始 md 与图片 和培训用的 ppt 和分享的 html与配套的 mac 上安装 claude code 指南

目前培训了 3 场,50 人次,反馈还行

大家如果有需求,欢迎拿去用

如果哪里有写的不对的,请告诉我后续还会有其他内容,脱敏后陆续更新上去

- AI 辅助标准化 PPT 自动化生成工作流-包含 ppt 风格固定,html 转换为 ppt 矢量图

- 财务如何摆脱手动操作表格-包含自定义 skills 快速创建,如何规避敏感数据泄露

- cc-switch 使用指南与 skills 管理与 LLM 真实请求分析

- etc图片的生成是使用 gemini 的网页+baoyu 老师的一些图作为参考图

作者: Mzs | 发布时间: 2026-04-09 09:12

34. 基于 K8S 实现的无限扩展的 tikrok v3 企业版

Tikrok 3.0

现代化内网穿透解决方案 - 精简架构,高性能,无限扩展

项目简介

Tikrok 是一个企业级 高性能内网穿透平台,采用 入口分离 + 数据平面无限扩展 的云原生架构设计。

核心特性

特性 说明 🚀 无限扩展 tikrokd-proxy 数据平面可水平无限扩展,支持 Kubernetes HPA 自动扩缩容 🏗️ 精简架构 仅四个核心组件,部署简单,运维成本低 📡 多协议支持 HTTP/HTTPS/TCP/UDP 全协议支持,满足各种场景需求 🔀 SMUX 多路复用 单连接多隧道,减少资源消耗,提升连接效率 ⚡ KCP 传输 基于 UDP 的高可靠传输层,降低延迟 30-50% 🔐 企业级安全 多层次 Token 认证、会话密钥加密、访问控制、审计日志 企业级特性

特性 描述 👥 多租户架构 用户注册、登录、订阅计划、资源隔离,支持 SaaS 模式运营 🎫 Token 分层管理 集成令牌(ti_)、用户令牌(tu_)、API Key 三层认证,精细权限控制 📊 流量统计计费 实时流量监控、用量统计、配额管理,支持按量计费模式 🔄 高可用容灾 无状态设计、自动故障转移、节点健康检查、优雅关闭机制 📈 监控可观测 Prometheus 指标、节点状态监控、隧道生命周期追踪 🛡️ 连接安全保障 SMUX keepalive 检测、连接超时清理、幂等资源管理 🔒 安全优势:可控端口暴露

创始人说 :设计 Tikrok 时,我反复思考一个问题——端口暴露风险是内网穿透的宿命 吗?

费斯汀格法则告诉我:生活中 10%由事件组成,90%由你的反应决定。

端口暴露风险客观存在,这是那 10%。但**如何应对,决定了安全的 90%**:

- ❌ 消极应对 :开放多端口 → 每个端口都是攻击入口 → 被动挨打

- ✅ 主动应对 :单端口穿透架构 → 集中管控、最小暴露 → 掌控安全命运

我选择主动应对。单端口架构不仅锁死了攻击面,还意外收获了百万级连接承载能力 ——因为无状态设计让每个端口都能无限扩展。这就是”正确应对”的蝴蝶效应。

传统内网穿透方案需要在防火墙开放大量端口,带来严重安全隐患。Tikrok 采用单端口穿透 架构:

对比项 传统方案 Tikrok 方案 防火墙端口 每个隧道一个公网端口 (22, 8080, 3306…) 仅开放 2 个端口 (8000/9000) 端口暴露风险 高风险 - 多端口多攻击面 低风险 - 单入口集中管控 防火墙规则 复杂 - 需频繁更新规则 简单 - 固定规则,永不变更 端口扫描暴露 易被发现 - 多端口探测 隐藏性好 - 最小端口暴露 流量审计 分散难以审计 集中入口,统一审计 架构优势:

传统方案 (危险): 防火墙开放: 22, 8080, 3306, 5353, 6379... ← 多端口暴露 │ │ │ │ │ ▼ ▼ ▼ ▼ ▼ SSH Web MySQL DNS Redis ← 每个服务直接暴露 Tikrok 方案 (安全): 防火墙开放: 仅 8000, 9000 ← 最小端口暴露 │ │ ▼ ▼ OpenResty tikrokd-proxy ← 统一入口,集中管控 │ │ └─────────┤ ▼ 用户服务池 (SSH/Web/MySQL...) ← 服务隐藏在内网

作者: 5wunian | 发布时间: 2026-04-09 08:19

35. Linux /Ubuntu 上如何实现连接两个不同的 wifi 解决实际需求。

背景:

- 自用电脑是联想小新 pro 14 ,装有 ubuntu24.04, 支持 wifi6

- 公司有 wifi A 和 wifi B ,wifi A 是国内的普通宽带,wifi B 是连接香港的专线。

- 服务器 ssh 连接限定了必须是使用 wifi A

- wifi B 由于是香港专线,可以自由访问谷歌等网站,无需翻墙。 使用 wifi A 则需要借助 Clash(虽然公司有订阅套餐)

目前我的需求是

- 指定某些软件/程序,例如是 teams,ssh 等使用 wifi A; 指定浏览器使用 Wifi A/B

求助大佬们,我应该如何实现上述需求?是否需要增购 USB wifi ?

作者: GuoDe1T | 发布时间: 2026-04-09 04:17

36. 一人说一个 AI 技巧、工具或者福利!

我先来:

- 免费 gpt-5.2, gemini-3.0-pro: https://www.codebuddy.ai/ 注册领 1000 积分,有效期一年

- 免费 glm-5: https://www.codebuddy.cn/ 注册领 4000 积分,有效期一年

作者: YiXinCoding | 发布时间: 2026-04-09 03:21

37. Windows 上面有类似 TimeMachine 的备份软件吗

rt

主要诉求是文件历史版本。以前用 mac 的时候,我记得一份文件从创造开始,每次变更保存,time machine 都会有一个单独的备份。

看了 windows 上面的备份软件,要么是单纯的备份,有增量备份的,需要定时运行。我记得 time machine 好像是后台一直再运行,保存在本地硬盘里,等跟 time machine 的硬盘链接的时候再转移过去。

想请问一下大佬,windows 上面有类似的软件吗?

作者: DesRafael | 发布时间: 2026-04-09 03:39

38. ChatGPT 推出 100 刀的 Pro 套餐

我们正在更新 ChatGPT Pro 和 Plus 订阅,以更好地支持 Codex 使用量的不断增长。

我们将推出一个新的每月 100 美元的 Pro 层级。这个新层级提供的 Codex 使用量是 Plus 的 5 倍,最适合较长、高强度的 Codex 会话。

在 ChatGPT 中,这个新的 Pro 层级仍然提供所有 Pro 功能访问权限,包括专属 Pro 模型以及对 Instant 和 Thinking 模型的无限访问。

为了庆祝推出,我们将临时增加 Codex 使用量,直至 5 月 31 日,这样 Pro 100 美元订阅者可以在 Codex 上获得高达 ChatGPT Plus 10 倍的使用量,以构建您最具雄心的创意

作者: Comyn | 发布时间: 2026-04-10 00:05

39. 用开源模型折腾个知识库(RAG)有必要没?

写代码。现在都是闭源模型一把梭。。遇到错误了总结个 skill 。反正也挺好用。

但是写鸿蒙这种就错误多一些,需要手动查文档之类的(虽然闭源也会差,但总感觉查准确率差一些),修起来费点时间。

有必要折腾个这种玩意嘛?

需求就是配合闭源的去完成工作。还是说继续闭源一把梭算了。。

作者: afkool | 发布时间: 2026-04-09 04:29

40. Claude Opus 似乎是官方降智了,洗车题失败

作者: germain | 发布时间: 2026-04-08 23:57

41. 在 CarPlay 中使用 ChatGPT 的语音模式进行口语练习是个不错的体验

尤其是一个人驾车/休息(辅助驾驶时)可以无压力闲聊

切记:安全第一 !!!

需要更多英语学习相关参考内容的可以查阅:

作者: livib | 发布时间: 2026-04-09 03:58

42. 最近几周 pyenvironments 总是工作不太正常

首先是”python.defaultInterpreterPath”似乎需要配置完整路径,用~来表示 home 目录似乎不支持了;

再就是”python.terminal.activateEnvInCurrentTerminal”能力似乎完全没有了,不管怎样新建 terminal 都不会自动 activate 环境了;

很不爽。

作者: zhwguest | 发布时间: 2026-04-09 05:41

43. Ai 出现之后,人与人的差距被放大了

看看 V2 的创意标签下发布的作品,就能看出来,创意、想象力、执行力真不是想有就能有的,最近在 vibecoding 一个小工具,画个 icon 折麽我一个星期,脑子里是一点东西都没有啊。

这边凌晨刚出来一个新技术或者新模型,那边喂饭教程天没亮就上线了,你们真是神人。

作者: FringJX | 发布时间: 2026-04-08 15:04

44. 关于 SDD 的几个方案

OpenSpec 、Spec-Kit 、BMAD 、GSD ,有几个深入用了一下。现在主要是项目开发久之后感觉太难维护了,即使用了上述的 SDD 方案,而且有些小功能的改动都要要花费很久的功夫、消耗很多 token ( OpenSpec 可能还好)。不知道有没有其他更好的方案?

作者: Yasuke | 发布时间: 2026-04-09 05:22

45. Claude Code 不是开源了吗?有人搞出一个二次开发版本吗?

按理说这么牛逼的东西,应该有人搞出自己的版本了吧。

那些做中转站的,难道不考虑搞一个自己的 IDE 吗?

作者: mzshxz | 发布时间: 2026-04-09 04:21

46. 才开始用 codex,发现有一个免费的 gpt-5.4

/status

╭─────────────────────────────────────────────────────────────────────────────────╮ │ >_ OpenAI Codex (v0.117.0) │ │ │ │ Visit https://chatgpt.com/codex/settings/usage for up-to-date │ │ information on rate limits and credits │ │ │ │ Model: gpt-5.4 (reasoning none, summaries auto) │ │ Directory: ~/workspace │ │ Permissions: Custom (workspace-write, on-request) │ │ Agents.md: <none> │ │ Account: xxx (Free) │ │ Collaboration mode: Default │ │ Session: xxx │ │ │ │ Context window: 80% left (61.4K used / 258K) │ │ Weekly limit: [██████████████████░░] 88% left (resets 15:56 on 14 Apr) │ ╰─────────────────────────────────────────────────────────────────────────────────╯ › Find and fix a bug in @filename gpt-5.4 default · 80% left · ~/workspaceClaudeCode 似乎没有这个 free plan 。 除外 web ,目前只可以在 Claude desktop 里用 free plan 。

作者: leiuu | 发布时间: 2026-04-09 08:01

47. 这世界变化太快了, 奶奶的

小龙虾还没搞顺, 又来了个 Hermes-agent

https://github.com/nousresearch/hermes-agent

不过 openclaw 是有点垃圾和臃肿, 今天的版本我直接无法对接本地的 omlx, 折腾一天了, 烦死.

作者: Hermitist | 发布时间: 2026-04-08 15:40

48. 昨晚 glm plan 跑到上限了按量付费用了下 qwen3.6 plus,感觉还行

写的是一个模仿 jetpack compose 的写法的 ui api ,但是底层使用另一套绘制引擎,我让 qwen 写的就是类 compose api 到这个特殊绘制引擎中间的布局计算和对绘制引擎的调用代码,效果不错,高于 glm4.7 低于 glm5.1 。

不知道是不是 qwen 定价比较便宜的原因,一个小时只跑了 10 块钱的 token ,工具用的 claude code 。

作者: defaw | 发布时间: 2026-04-09 04:04

49. v2.1.97 版本 /buddy 被官方移除了

啊这,一周体验券吗?留着感觉也没什么影响啊。

作者: spike0100 | 发布时间: 2026-04-09 03:23

50. 大佬们都用什么 AI IDE?

还是喜欢用 IDE ,可以看文件夹和文件。模型目前用 sonnet4.6 就很满意,cursor pro 到期没续了,不经用。Gemini pro 在反重力上面比 cursor 更不经用,几个号来回换也麻烦。现在用 kiro ,首月 1500 积分 5 天就用完了。 想买个 Gemini ultra 来用反重力,但是看 L 站上的人说跟 Claude pro 的额度差不多。 请问 V 站大佬们都是用的啥啊?

作者: blueslmj | 发布时间: 2026-04-08 03:16